这是一篇有关于计算机的博士论文,本文针对当前机器学习领域中重要而困难的问题—小样本导致方法泛化性能受限、小样本伴随不平衡性和小样本伴随风格信息(即:非独立同分布数据)的分类问题—进行了深入研究与探讨。小样本导致方法泛化性能受限主要挑战由于数据的稀缺性,模型可能会过于关注训练数据中的噪声和局部特征,而无法泛化到新数据。小样本伴随不平衡性的主要挑战在于数据量的有限和类别之间的不平衡性,这使得模型难以学习到足够的数据特征,从而影响其泛化能力和性能。

第一章 绪 论

1.1 研究背景及意义

1.1.1 研究背景人工智能技术,特别是以机器学习为核心的技术,在过去几年中以惊人的速度渗透到了各个领域,涵盖工业、农业、军事、教育、服务、医疗保健、社会管理、企业管理、经济金融、艺术创作以及文化娱乐等。广泛的应用使得人工智能技术成为未来社会生产和生活的主要变革推动力之一。特别是机器学习在现代产业中产生了革命性的影响和巨大的推动作用,引领着新一轮的科技革命浪潮。许多国家,包括中国、美国、日本以及欧盟国家等,已经将以机器学习为核心的人工智能的理论研究和产业应用视为新的国家战略重点,以提升各国的产业竞争力,助力经济和社会的可持续发展。这表明了机器学习不仅仅是科技领域的一项创新,也已经成为国家和全球未来发展的关键驱动力。回顾过去,机器学习领域取得了巨大的进展。不仅在理论研究方面取得了爆发性的增长,而且在实际应用中也呈现出了改变生产方式和日常生活的潜力。这一技术的广泛应用正在为社会带来深远的影响。以下是几个最具代表性的机器学习应用案例:(1) 医疗诊断和治疗优化:机器学习在医疗领域的应用已经带来了革命性的变化。通过分析大量的医疗数据,机器学习算法能够辅助医生进行疾病诊断、预测疾病风险、优化治疗方案等。例如,深度学习模型可以从医学影像中自动检测肿瘤、病变和其它异常,提高了诊断的准确性和效率。(2) 智能个性化推荐系统:许多在线平台利用机器学习算法来提供个性化的推荐服务,如视频流媒体平台、电子商务网站和社交媒体平台等。这些算法分析用户的历史行为、偏好和兴趣,以预测用户可能感兴趣的内容或产品,并将它们推荐给用户,从而提高用户体验和平台的粘性。(3) 智能交通与城市规划:机器学习技术被广泛应用于交通管理和城市规划领域,以优化交通流量、改善交通安全和减少环境污染。智能交通系统可以通过实时数据监测交通状况,并根据需求调整交通信号灯、优化路线规划等,以提高交通效率和减少拥堵。(4) 金融风险管理:金融机构利用机器学习算法来识别和管理风险,包括信用风险、市场风险和操作风险等。这些算法可以分析大量的金融数据,发现潜在的风险因素,并提供预测和决策支持,帮助金融机构更好地管理风险并做出更明智的投资决策。(5) 自然语言处理和语音识别:随着自然语言处理和语音识别技术的进步,机器学习在文本分析、情感分析、语义理解、语音识别等方面取得了重大突破。这些技术被广泛应用于智能助手、自动翻译、智能客服等领域,极大地提高了人机交互的效率和便利性。在机器学习和人工智能领域,经常听到有关各种引人注目的成功案例的报道,这些案例展示了这一领域的巨大潜力和光明前景。然而,本文的目的并不在于再次突出强调这些成功故事,

目录

摘要

Abstract

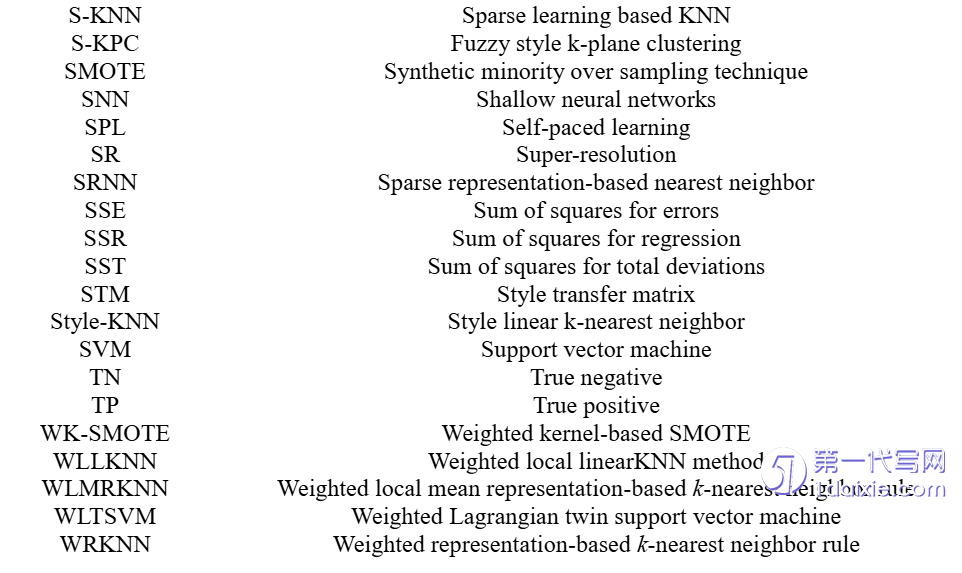

英文缩写索引清单

第一章 绪论

第二章 本文研究相关的分类技术与评估方法

第三章 不平衡数据扩充及分类的 EKB-SMAOTE 方法

第四章 自步学习线性KNN分类方法

第五章 自适应K近邻线性KNN分类方法

第六章 风格线性KNN分类方法

第七章 共享风格线性KNN分类方法

总结与展望

参考文献

而是更为专注于探讨机器学习在工程应用中可能会面临的一项关键挑战,即小样本数据集。这种关注的转移是出于对更全面了解机器学习领域现状和未来方向的迫切需要。随着机器学习应用的不断扩大,在实际工程项目中,数据量有时可能非常有限,而不仅仅是丰富的大规模数据集。例如,在医疗诊断领域,由于个人隐私和数据获取的限制,可以使用的数据量可能非常有限。这就需要开发出能够在小样本情况下工作的机器学习模型。此外,在一些新兴领域或特定的应用场景中,数据收集本身可能就很困难,因此也会面临类似的问题。小样本数据集的特点包括数据量较少,通常只有几十到几百个样本,因此容易受到数据的不平衡、高噪声以及无法全面代表全局分布的影响。由于样本数量有限,数据集往往不足以覆盖数据的全局特征分布,这可能导致模型在未见过的数据上表现不佳。同时,由于数据量少,难以有效地划分验证集和测试集,可能对评估模型性能时的准确性产生影响。当小样本数据伴随着不平衡因素时,由于少数类别的样本数量有限,模型可能无法充分学习这些类别的特征。这可能导致模型对少数类别的预测性能不佳,而多数类别的性能较好。此外,在现实世界中,许多数据集都不满足独立同分布的假设,因为它们可能受到多种因素的影响,如时间、空间、群体差异等。这导致数据之间存在复杂的相关性和不确定性,从而增加了预测的难度。这类数据被称为风格数据(Stylistic dataset)[1]。当小样本数据伴随着风格信息时,选择合适的模型变得更加困难,需要根据数据特点和问题需求选择合适的模型结构。小样本数据集是机器学习工程应用中的一项重要挑战。因此,处理小样本数据集需要特别谨慎。接下来详细列举了小样本数据集面临的具体问题以及现有的解决办法:(1) 小样本导致方法泛化性能受限的问题:小样本数据集通常包含非常有限数量的样本,这可能是由于成本高昂、数据收集困难或时间限制。因此,模型在训练时只能观察到有限数量的数据点,这可能导致难以准确地捕捉数据的真实特征和分布。由于数据的稀缺性,模型可能会过于关注训练数据中的噪声和局部特征,而无法泛化到新数据。这会导致在测试集或实际应用中性能下降。解决该问题,研究人员提出了一系列方法和技术:迁移学习(Transfer learning)[2]、数据增广(Data augmentation)[3]、基于生成对抗网络的方法[4]、集成学习[5]等。这些方法和技术旨在克服小样本数据集带来的问题,提高模型在实际工程应用中的性能和可靠性。迁移学习利用从一个相关领域或任务中学到的知识来改善目标任务的学习效果。通过在一个大型数据集上预训练模型,然后将其用于小样本数据集上,可以提高模型的性能。数据增广是通过对原始数据进行变换或扩充来生成更多的训练样本。生成对抗网络 (Generative adversarial network,GAN)[4]可以用来生成合成数据,从而扩充训练集。这些合成数据在一定程度上反映了真实数据的分布,有助于提高模型的泛化性能。在小样本情况下,过于复杂的模型容易过拟合。因此,可以选择较简单的模型架构,如线性模型或浅层神经网络(Shallow neural networks, SNN)[6],并通过正则化等方法来减少模型的复杂度。集成多个不同的模型也是一种有效的方法。通过结合多个模型的预测结果,可以降低过拟合的风险,并提高整体性能。另外针对具体方法而言,还要在具体方法应对具体任务做特别优化。可能会倾向于预测多数类别,因为这样可以最小化训练误差。这导致了对少数类别的预测性能下降,因为模型没有足够的数据来学习有关少数类别的信息。而一些数据增广的技术在对少数类样本进行扩充时破坏了数据的可分性,例如 SMOTE 方法。因此如何设计数据增广技术以及其它技巧提高机器学习方法在不平数据集上对少数类样本的泛化性能成为关键。解决该问题,通常涉及一系列策略的综合应用[7],旨在提升机器学习模型对少数类别的识别能力,从而达到更公正和准确的预测结果。这包括采用重采样技术[3],如过采样少数类别[3, 8]以增加其在数据集中的代表性,或欠采样多数类别[9]以减少数据偏差。同时,通过调整分类器的工作机制,如修改分类阈值[10]或采用成本敏感学习算法,强化对少数类别的关注。集成学习方法,如利用Bagging[11]或 Boosting[12]技术,可以通过组合多个分类器的决策来提高对少数类别的预测准确性。此外,精心设计的特征工程[13],包括特征选择和转换,能够显著提升模型区分不同类别的能力。在深度学习领域,数据增广和特定的损失函数,如焦点损失[14],被广泛应用于改善少数类的学习效果。最后,采用适宜的评估指标,如 F1 分数和 AUC-ROC[15]曲线,能够更全面地反映模型对于不平衡数据处理的性能,确保了评估过程的公正性和全面性。(3) 小样本伴随风格信息的分类问题:在处理风格数据分类问题时,由于该类型数据不服从独立同分布,意味着训练数据集中的分布可能无法完全代表测试集或未来数据的分布,从而降低模型的泛化能力。此外非独立同分布数据可能源自多个不同的分布,这些分布可能代表不同的群体、条件或类别。这种异质性要求模型能够识别和适应不同的分布特征,增加了模型设计和训练的复杂度。解决该问题,研究人员提出了许多新的方法和技术。例如,深度学习(Deeplearning, DL)[16]通过多层次的非线性变换可以更好地捕捉数据之间的复杂关系,从而提高了对非独立同分布数据的预测能力。此外,集成学习方法如随机森林(Random Forest, RF)[17]和梯度提升树(Gradient boosting decision tree, GBDT)[18]等可以结合多个模型的预测结果,从而减少因为数据分布变化而导致的预测误差。另一方面,领域自适应(Domain adaptation, DA)[19]和迁移学习[2]等技术也被广泛应用于处理非独立同分布数据。这些方法通过将知识从一个领域迁移到另一个领域来提高模型的泛化性能,从而更好地适应不同数据分布的情况。尽管面对小样本数据集的这些挑战,研究人员提出的一些方法有效地解决了小样本数据分类的问题。一些传统方法在小样本数据集和非独立同分布数据集上具有独特优势,例如其中的K 近邻(K-nearest neighbors, KNN)方法备受瞩目,其独特之处在于,它不依赖于庞大的数据集,而是倚赖样本之间的相似度度量。本文旨在探讨并研究基于 KNN 方法在应对这些挑战时的效果。

第二章 本文研究相关的分类技术与评估方法

围绕本文研究相关的几个关键技术和方法,分别对这些技术和方法进行介绍。具体而言,将介绍以下内容:支持向量机、合成少数类过采样技术、线性 KNN 方法、自步学习、总偏差的平方和、自适应 K 值、风格转换矩阵和场支持向量机方法等。首先,在 2.1 小节将介绍支持向量机(Support vector machine, SVM)[33],这是一种广泛应用于分类和回归问题的强大监督学习算法。紧接着,在 2.2 小节探讨合成少数类过采样技术[3],它是解决不平衡数据集问题的一种有效方法。随后,在 2.3 小节讨论线性 KNN 方法,这是 KNN 方法上扩展而来,具有显式的数学模型结构。在 2.4 小节介绍了自步学习(Self-paced learning, SPL)[84],它为获得样本重要性提供了新颖的视角。在 2.5 小节讨论了总偏差的平方和(Sum of squares for total deviations, SST)[85],这是一种衡量所有样本之间的差异。在 2.6 小节介绍了自适应 K 值[71-78]的相关方法,这对于提高 KNN 方法的性能至关重要。在 2.8 小节将介绍风格转换矩阵(Style transfer matrix, STM)[82]方法,它在图像和视频处理领域中具有重要应用。最后在 2.9 小节介绍了场支持向量机(Fieldsupport vector machines, F-SVM)[79],这是一种新兴的机器学习技术,首次探索了支持向量机在同一组样本中获取风格信息的可行性。此外,在本章最后一小节介绍了本文实验中所使用的评价指标。2.1 支持向量机支持向量机(Support vector machine, SVM) [33]是一种监督学习方法,通过找到在不同类别之间建立最大间隔的超平面,从而实现有效的分类和回归。它的基本原理根植于统计学习理论,遵循结构风险最小化原理,以确定最优的分类面。对于原始特征空间中的不可分问题,SVM 引入了核函数,将数据映射到高维特征空间,将原问题转化为线性约束的二次规划问题。例如,在原始二维特征空间中,人工样本集 S 可能不具备线性可分性。通过映射函数将其映射到高维空间,从而可以利用超平面实现数据的可分离,如图 2-1 所示。

第三章 不平衡数据扩充及分类的 EKB-SMAOTE 方法

3.1 引言

本章将重点研究如何将多个传统 K 近邻方法应用于多个核空间对数据进行数据增广。该数据增广方法往往需要配合基于核空间的分类器(如:SVM)来使用。提高了 SVM 在该增强数据策略的情况下很好的解决了不平衡数据的泛化性不足的问题。如 1.2.1 所介绍的,尽管有这么多方法来解决不平衡数据分类问题,然而不平衡数据的分类不可避免的面临以下挑战:(1) 当处理不平衡数据时,使用 SMOTE 方法进行样本扩充是一种常见的方法。然而,在实际应用中,使用 SMOTE 可能面临生成的合成样本中噪声过多的问题,这可能会影响分类器的性能。这种噪声主要是由于 SMOTE 方法的工作方式,即在原始空间中插值生成合成样本。(2) 虽然有一些研究针对不平衡数据集的单个分类方法,但针对多个核空间的不平衡数据集的集成方法研究相对较少。多核学习方法通常集中在正常平衡的数据集上,对于不平衡数据集的处理方式仍然需要更多的研究。为了应对这两个挑战,本章提出了一种解决不平衡数据分类问题的集成级方法。首先,提出了基于核的合成多数群体超采样技术(Kernel-based synthetic majority oversampling technique,KB-SMAOTE)方法。该方法根据核函数将合成数据样本添加到多数类中。这些合成数据样本接近于核空间中的少数类样本。它们还受到多数类数据在核空间中分布的影响,这使得多数类样本点和少数类样本点在核空间中的边界更加密集,从而使决策平面偏向于多数类数据。基于KB-SMAOTE 方法,本章设计了三个基于核的合成多数群体超采样技术 KB-SMAOTE 分类器形成集成级 KB-SMAOTE(Ensemble kernel-based synthetic majority oversampling technique, EKB-SMAOTE)方法。EKB-SMAOTE 方法使用三个 SVM 分类器,调节每个 SVM 超平面相对于每个特征空间中训练集的所有样本点的几何平均区间最小。本章的贡献如下:(1) 提出一种新的基于核的引导式数据扩增(Kernel-based guided data augmentation, KB-GD)方法。并对该过程重复多次,减少由于随机带来的影响。由于生成的合成数据点接近于少数类样本,并受多数类数据在核空间中分布的影响,提出的方法可以使得决策平面更加偏向于多类数据,从而提高了对少数类的分类决策的准确性。(2) 通过设计基于核的合成多数群体超采样技术(KB-SMAOTE),不同于 SMOTE 方法对少数类进行数据增广。在特征空间中使用传统 KNN 方法稠密化多数类和少数类的边界。KB-SMAOTE 使用 SVM 分类器,将原始数据映射到特征空间,以最小化每个特征空间中的训练集的几何平均区间,该方法还提高了模型的泛化性能。(3) 将 KB-GD 以及 KB-SMAOTE 方法应用到多个核空间形成 EKB-SMAOTE 方法。从集成级解决不平数据的泛化精度差的问题。此外,本章还通过理论证明了所提的 KB-SMAOTE 方法生成的多类合成样本点对于少类在核空间中具有可分性。(4) 在基准数据集上的实验发现,所提出的 EKB-SMAOTE 方法对不平衡数据集具有良好的泛化性能。3.2 设计动机和 EKB-SMAOTE 方法本节将设计一种更有效的不平衡数据过采样方法,以克服 SMOTE 方法的缺点。在本节的开头,通过简单的证明来说明 SMOTE 方法的缺点。SMOTE 方法在一定程度上解决了不平衡数据的分类问题,但也会增加类间重叠的可能性,产生一些无效类信息的样本点。虽然无法在高维数据中显示这一缺点,但可以从二维数据中显示这一缺点。如图 3-1 所示,少数类和多个类是一个封闭的结构。其中,红色圆圈 :多数样本点。绿色圆圈 :少数样本点。蓝色叉 :合成样本。

第四章 自步学习线性 KNN 分类方法

4.1 引言在前一章节中深入探讨了传统 KNN 方法在处理不平衡数据过采样中的有效应用,并提出了多种核空间数据增广技术,还探讨了如何结合多个 SVM 来有效提高在不平衡数据分类的泛化性能。本章开始探讨使用 KNN 方法作为分类器对小样本数据分类的一些创新方法。KNN 方法之所以吸引人,部分原因在于它打破了传统上对训练数据和测试数据保持一致数据分布的常规假设。在 KNN 方法中,没有预先的训练过程;相反,它直接利用测试数据的 K 个最近邻训练样本来进行预测。这种方法在处理训练数据与测试数据虽相似但分布不一致的场景下,表现出了令人瞩目的性能。然而,尽管 KNN 在这方面表现卓越,它仍面临着几个关键性的挑战需要解决:(1) 由于贝叶斯决策规则具有强选择性,因此如何设计一个合适的 K 值来进行类似贝叶斯决策规则的预测方法。甚至 K 值的选择也应针对不同的测试数据进行自适应选择;(2) KNN 方法的性能可能受到噪声、异常值或不平衡数据分布的影响,欧氏距离在空间中容易失去效用,因此如何改进 KNN 以减小分类误差是一个关键问题;(3) KNN 的预测应同时考虑每个类的分组效应和训练邻域的重要性,以避免高维欧氏数据空间的“相同簇”(意味着相同分类)现象[109-111]。为了应对上述部分挑战,已有一些研究从线性 KNN 角度寻求突破。首先通过所有训练样本的局部约束线性编码器来表示测试样本[112],然后对每个类别的训练样本的非零线性权重求和来预测测试样本标签。典型的方法包括 LLC、Elastic Net 和 LASSO 方法。所有这些方法都是先通过推导测试样本的相应稀疏表示,建立测试样本和训练样本之间的直接关系,然后根据建立的稀疏表示对测试样本进行分类。显然,通过计算或截断这些稀疏表示中的非零权重,可以实现 KNN 中 K 值的自适应选择。除了最小化测试样本与所有训练样本之间的重构误差外,LASSO 方法还考虑了重构的稀疏性。在 LASSO 方法的基础上,Elastic Net 方法进一步考虑了对所有训练样本分组效应的附加正则项,以改善测试样本的稀疏表示。显然,这种对所有训练样本的分组效应是不合适的,因为它不能利用训练样本中的类标信息。换句话说,对每个类别的分组效果更能突出每个类别中重建的稀疏性。LLC 方法尝试最小化重建误差,同时保持局部平滑稀疏性,以确保更好的重建性能。然而,这种方法的预测行为无法用贝叶斯决策规则等可靠的依据来解释。最近, LLK 方法分享了上述稀疏表示法的精髓,同时使线性 KNN 具有贝叶斯决策规则,从而在视觉识别领域取得了成功。然而,LLK 方法对权重进行了简单的截断,而没有考虑训练样本在所得到的稀疏表示中的重要性,这确实降低了 KNN 自适应选择的能力。在这种情况下,基于稀疏表示的理想线性 KNN 应该表现得像贝叶斯决策规则一样,其预测行为具有可解释性。此外,它既能充分利用类标信息,又能根据每个类别的训练样本的重要性和分组效应自适应地选择 K 值。为此,本章研究开发了一种自步学习与贝叶斯决策规则线性 KNN 分类方法(Self-paced & Bayes decision rule linear KNN prediction method, SBLD-KNN),该方法的独特价值体现在两个方面:(a)利用自步学习来确定每一类训练样本的重要性;(b)设计类标信息正则化器来实现对训练样本的分组效应,从而使 SBLN-KNN 的预测行为类似于贝叶斯决策。更具体地说,SBLD-KNN 方法的贡献归纳如下:(1) 在目标函数中设计了一个新颖的分组效应正则项。通过理论分析表明,有了这个项,SBLD-KNN 方法确实具有贝叶斯决策规则,且分类误差最小。(2) 在 KNN 中首次引入了自步学习,用于识别训练样本的重要性。现有的基于稀疏表示的 KNN 通过计算或截断稀疏表示中的非零权重来自适应地确定测试样本的 K 值,而训练样本的重要性识别将有助于提供更合适的 K 值。(3) 由于 SBLD-KNN 方法的目标函数有两个参数需要同时优化,无法进行解析求解,因此本章研究采用了著名的交替优化策略来优化 SBLD-KNN 方法的目标函数。(4) 在 15 个基准数据集上的实验结果表明,SBLD-KNN 方法的预测性能至少与比较方法相当,甚至更具优势。

第五章 自适应 K 近邻线性 KNN 分类方法

5.1 引言

在上一章中阐述了自步学习的重要性,这使得所提出的方法能够逐步获取训练样本,并灵活地选择适合的 K 值,从而提升 SBLD-KNN 方法的泛化性能。根据 SBLD-KNN 方法的目标函数可知,有四个正则化参数。然而,过多的正则化参数会导致优化和最优参数选择方面的困难。因此,在本章研究中提出了一种具有更少正则项参数的自适应近邻的新型贝叶斯决策线性KNN(Bayes-decisive linear KNN with adaptive nearest neighbors, BLA-KNN)。所提出的 BLA-KNN方法的贡献总结如下:(1) BLA-KNN 方法引入可训练对角矩阵作为近邻重要性。测试样本的预测标签受线性表达权重稀疏性、距离度量和近邻重要性的综合影响。最终,针对不同的测试样本,可以更灵活地选择近邻。(2) 可以使用最小误差贝叶斯决策规则来解释所提出的 BLA-KNN 方法的预测规则。此外,本章还从理论上证明了所提出的 BLA-KNN 方法具有近邻组效应,这为所提出的 BLA-KNN 方法在所采用的基准数据集上具有良好的泛化性能提供了更好的解释。(3) 所提出的 BLA-KNN 方法的目标函数可通过交替优化策略进行优化[1, 110]。因此,所提出的 BLA-KNN 方法易于实现。实验证明了优化策略的有效性。(4) 在 15 个基准数据集上通过准确率排名和统计分析得出的实验结果表明,所提出的BLA-KNN 方法至少获得了与比较方法相当的结果,甚至表现得更好。本章研究的其余部分安排如下。第 5.2 小节介绍了所提出的 BLA-KNN 方法,包括其目标函数、优化过程和理论分析。第 5.3 小节报告了在 15 个基准数据集上的实验结果和讨论。第5.4 小节是本章研究的结论。在开始介绍方法前,在不失一般性和简洁性的前提下,将相同类别标签的样本排列在其最近的邻近位置来对样本矩阵进行归一化处理。5.2 所提出的 BLA-KNN 方法本节将详细介绍 BLA-KNN 方法的动机和实现过程。首先,通过图示简要介绍所提出的BLA-KNN 方法的整体框架,如图 5-1 所示。如图 5-1 所示。在步骤(1)中,首先对音频、图像和文本原始数据进行预处理,以实现特征降维,从而降低分类方法的时间复杂度。在步骤(2)中,对降维后的数据进行 L2 范数归一化处理,以消除离散/歧义数据对训练过程的不利影响。在步骤(3)中,将归一化后的数据加载到所提出的 BLA-KNN 方法中,然后通过交替优化策略获得线性表达权重向量w 和从训练样本到测试样本的训练样本重要性权重矩阵Ω 。在步骤(4)中,利用预测规则获得测试样本的预测标签。接下来,将详细分析该框架步骤(2)所包含的理论。

第六章 风格线性 KNN 分类方法

6.1 引言

正如前两章节所述,尽管 KNN 方法对数据的分布没有统一的要求,但现有的线性 KNN方法却需要数据的一致性,这限制了它们在处理非独立同分布数据时的效能。在本章及后续章节中将聚焦于分类问题中的另一个复杂挑战——风格分类问题。正如之前章节所介绍的,现有的线性 KNN 方法[59, 61-65, 76-78]基本区分为两种技术路线:(1) 通过对权重使用额外的正则项来改进线性表达权重[59, 61-64],例如 LASSO, Elastic Net,LLC, LLK/LLKNN 和 WLLKNN 方法。(2) 自适应地选择 K 近邻(即 K 值)以获得可靠而准确的近邻数量,例如 S-KNN、GS-KNN和 One-Step KNN。因此,当数据集服从独立同分布(i.i.d)的普通数据集时,这些线性 KNN 方法可以根据表观特征(即物理特征)在样本空间中的分布,准确地获得测试样本的标签,并能在普通数据集上实现更强的泛化性能。然而,在许多应用中,这些线性 KNN 方法的泛化性能在某些数据集(即:这些数据集不服从 i.i.d)上可能会被削弱。根据现有定义[79],具有相同模式或类别的样本隐式或显式地共享相同的数据风格(即同质风格),从而使属于同一类别的样本具有潜在的统一属性并形成统计依赖关系[79, 80],称为风格数据集[79]。典型数据集的例子包括癫痫脑电图(Electroencephalogram, EEG),元音识别,以及手写识别数据集[79]。图 6-1 展示了普通数据集和风格数据集的分类示例。图 6-1 清楚地表明叶片分类任务倾向于利用叶片图像中叶脉纹理的潜在特征(即风格特征)而不是物理特征(如颜色特征),因此,现有适用于普通数据集的线性 KNN 方法[59, 61-65, 76-78]无法处理风格数据集,提高线性 KNN 方法对风格数据集的泛化性能是当务之急。

第七章 共享风格线性 KNN 分类方法

7.1 引言

如上一章(第六章)所介绍的,在现实世界的许多场景中,相同标签的样本具有相同的风格特征,从而导致统计意义上的显著依赖性。这类数据被称为风格数据集[79]。虽然有一些方法[1,79-83]专注于风格数据集的分类问题,并取得了出色的分类泛化性能。这些方法只关注单个测试样本和训练样本之间的风格相似度,而忽略了多个测试样本之间的共享风格和训练样本之间的风格相似度。本章旨在通过在线性 KNN 方法中嵌入共享风格的挖掘能力,提高线性 KNN 方法的分类泛化性能。为了便于理解普通分类、风格分类和共享风格分类之间的区别。使用图 7-1 对三者进行简要说明。图 7-1 以字体分类为例,共考虑了 9 个测试样本,说明了这种新型风格分类方法、现有风格分类方法和经典分类方法对这些测试样本的预测差异。更具体地说,根据图 7-1 (a),经典分类方法不考虑每个测试样本(见每个实心矩形)与相应训练样本之间的风格亲和性。它对每个测试样本都进行了单独预测,因此产生了四个错误分类的测试样本(见3y ,4y,7y 和8y )。根据图 7-1 (b),风格分类方法非常重视每个测试样本的风格,而这也是源样本的固有特点,因此风格分类结果相当出色,只有两个测试样本被错误分类。如图 7-1 (c)所示,假设所有九个测试样本都有三个同源集(见三个实心椭圆),其中每个同源集都有相同的风格,新颖的风格分类方法通过考虑每个同源集的共享风格和训练样本的风格来预测每个同源集,从而得出每个正确分类的组,也就是其中的每个测试样本。

总结与展望

总结本文针对当前机器学习领域中重要而困难的问题—小样本导致方法泛化性能受限、小样本伴随不平衡性和小样本伴随风格信息(即:非独立同分布数据)的分类问题—进行了深入研究与探讨。小样本导致方法泛化性能受限主要挑战由于数据的稀缺性,模型可能会过于关注训练数据中的噪声和局部特征,而无法泛化到新数据。小样本伴随不平衡性的主要挑战在于数据量的有限和类别之间的不平衡性,这使得模型难以学习到足够的数据特征,从而影响其泛化能力和性能。而非独立同分布数据集的挑战则源于数据的分布复杂性和动态变化性,这对模型的适应性和预测精度提出了更高要求。面对这些挑战,本文提出了一系列创新的机器学习方法与策略:(1) EKB-SMOTE 方法提出在核空间中通过核引导的数据扩增 SG-BD 方法,使多类边界更加稠密。EKB-SMOTE 创新性地将核空间生成训练样本提升到集成级,并通过理论证明了该改进的可行性,旨在解决不平衡数据分类中分类精度偏向多数类而忽略少数类的问题。(2) SBLD-KNN 方法通过线性重构测试样本,引入自步学习实现了线性 KNN 的自适应 K值选择功能。这一措施显著提高了 SBLD-KNN 方法在多个数据集上的泛化性能。此外,还通过理论证明了 SBLD-KNN 方法的预测行为可以用贝叶斯决策规则来解释,大大增强了预测行为的可解释性。(3) 基于 SBLD-KNN 方法,BLA-KNN 方法进一步研究了局部线性 KNN 的自适应 K 值和正则项。相比于 SBLD-KNN 方法,BLA-KNN 方法使用更少的正则化项和正则化参数,并引入可训练的对角矩阵来获取训练样本的重要性权重。同时,BLA-KNN 方法继承了 SBLD-KNN方法良好的数学特性。(4) Style-KNN 方法在线性 KNN 方法的基础上,创新性地引入风格矩阵和风格隶属度,解决了风格数据集中训练样本和测试样本不满足独立同分布假设时分类泛化性差的问题。通过增强节点保证训练数据中的流形结构,防止风格矩阵退化为单位矩阵。结果表明,所提出的风格线性 K 近邻分类方法在普通准数据集上表现出了不弱于对比方法的泛化性能,特别是在处理具有风格特征的数据集时,展现出良好的适应性和泛化性。(5) SSL-KNN 方法通过利用训练样本与同源集之间共享的风格信息,进一步提高了风格数据分类的泛化性能。这解决了 Style-KNN 方法在多次预测时每次预测都是独立进行,未能捕获共享风格信息的问题。SSL-KNN 方法能够更准确地表示同源集的风格信息,有效区分非独立分布的风格数据集中各种风格之间的微小差异。此外,通过引入高斯核函数约束同源集的线性表达权重,增强了距离属性的精确度,并引入风格隶属度向量进一步提升分类泛化能力。展望展望未来,随着机器学习领域的不断发展,可以预见这些创新方法与策略将在解决数据不平衡和非独立同分布等难题方面继续发挥重要作用。

参考文献

[1] GU S, NOJIMA Y, ISHIBUCHI H, et al. Fuzzy Style K-Plane Clustering [J]. IEEE Transactions on Fuzzy Systems,2021, 29(6): 1518-32.

[2] WEISS K, KHOSHGOFTAAR T M, WANG D. A survey of transfer learning [J]. Journal of Big data, 2016, 3(1): 1-40.

[3] CHAWLA N V, BOWYER K W, HALL L O, et al. SMOTE: synthetic minority over-sampling technique [J]. Journalof artificial intelligence research, 2002, 16: 321-57.

[4] WANG K, GOU C, DUAN Y, et al. Generative adversarial networks: introduction and outlook [J]. IEEE/CAA Journalof Automatica Sinica, 2017, 4(4): 588-98.

[5] DONG X, YU Z, CAO W, et al. A survey on ensemble learning [J]. Frontiers of Computer Science, 2020, 14: 241-58.

[6] JUDD S. On the complexity of loading shallow neural networks [J]. Journal of Complexity, 1988, 4(3): 177-92.

[7] HAIXIANG G, YIJING L, SHANG J, et al. Learning from class-imbalanced data: Review of methods andapplications [J]. Expert Systems with Applications, 2017, 73: 220-39.

[8] KOTSIANTIS S, KANELLOPOULOS D, PINTELAS P. Handling imbalanced datasets: A review, gests internationaltransactions on computer science and engineering 30 (2006) 25–36 [J]. Synthetic Oversampling of Instances UsingClustering.

[9] WILSON D R, MARTINEZ T R. Reduction Techniques for Instance-Based Learning Algorithms [J]. MachineLearning, 2000, 38(3): 257-86.

[10] YU H, MU C, SUN C, et al. Support vector machine-based optimized decision threshold adjustment strategy forclassifying imbalanced data [J]. Knowledge-Based Systems, 2015, 76: 67-78.

[11] BüHLMANN P, YU B. Analyzing bagging [J]. The annals of Statistics, 2002, 30(4): 927-61.

[12] SCHAPIRE R E. A brief introduction to boosting; proceedings of the Ijcai, F, 1999 [C]. Citeseer.

[13] NARGESIAN F, SAMULOWITZ H, KHURANA U, et al. Learning Feature Engineering for Classification;proceedings of the Ijcai, F, 2017 [C].

[14] LIN T-Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection; proceedings of the Proceedings of theIEEE international conference on computer vision, F, 2017 [C].

[15] NARKHEDE S. Understanding auc-roc curve [J]. Towards data science, 2018, 26(1): 220-7.

[16] BOCHKOVSKIY A, WANG C-Y, LIAO H-Y M. YOLOv4: Optimal Speed and Accuracy of Object Detection [J].ArXiv, 2020, abs/2004.10934.

[17] TIN KAM H. Random decision forests; proceedings of the Proceedings of 3rd International Conference on DocumentAnalysis and Recognition, F 14-16 Aug. 1995, 1995 [C].

[18] KE G, MENG Q, FINLEY T, et al. Lightgbm: A highly efficient gradient boosting decision tree [J]. Advances in neuralinformation processing systems, 2017, 30.

[19] FARAHANI A, VOGHOEI S, RASHEED K, et al. A brief review of domain adaptation [J]. Advances in data scienceand information engineering: proceedings from ICDATA 2020 and IKE 2020, 2021: 877-94.

[20] KUMAR V, MINZ S. Feature selection: a literature review [J]. SmartCR, 2014, 4(3): 211-29.

[21] WOLD S, ESBENSEN K, GELADI P. Principal component analysis [J]. Chemometrics and intelligent laboratorysystems, 1987, 2(1-3): 37-52.

[22] HAN H, WANG W-Y, MAO B-H. Borderline-SMOTE: A New Over-Sampling Method in Imbalanced Data SetsLearning; proceedings of the Advances in Intelligent Computing, Berlin, Heidelberg, F 2005//, 2005 [C]. SpringerBerlin Heidelberg.[23] HAIBO H, YANG B, GARCIA E A, et al. ADASYN: Adaptive synthetic sampling approach for imbalanced learning;proceedings of the 2008 IEEE International Joint Conference on Neural Networks (IEEE World Congress onComputational Intelligence), F 1-8 June 2008, 2008 [C].

[24] ZENG Z-Q, GAO J. Improving SVM Classification with Imbalance Data Set; proceedings of the Neural InformationProcessing, Berlin, Heidelberg, F 2009//, 2009 [C]. Springer Berlin Heidelberg.

[25] VAN HULSE J, KHOSHGOFTAAR T. Knowledge discovery from imbalanced and noisy data [J]. Data & KnowledgeEngineering, 2009, 68(12): 1513-42.

[26] Two Modifications of CNN [J]. IEEE Transactions on Systems, Man, and Cybernetics, 1976, SMC-6(11): 769-72.

[27] WILSON D L. Asymptotic Properties of Nearest Neighbor Rules Using Edited Data [J]. IEEE Transactions onSystems, Man, and Cybernetics, 1972, SMC-2(3): 408-21.

[28] GROCHOWSKI M, JANKOWSKI N. Comparison of Instance Selection Algorithms II. Results and Comments [M].2004.

[29] URLAUB H, RAKER V A, KOSTKA S, et al. Sm protein–Sm site RNA interactions within the inner ring of thespliceosomal snRNP core structure [J]. The EMBO Journal, 2001, 20(1-2): 187-96-96.

[30] YEN S-J, LEE Y-S. Cluster-based under-sampling approaches for imbalanced data distributions [J]. Expert Systemswith Applications, 2009, 36(3): 5718-27.