本文是一篇医学论文,本研究使用改进的自适应阈值的CPDA角点检测方法能够精确地检测特征点的位置,与预先设定好固定阈值的CPDA角点检测方法相比通过构建的自适应阈值函数避免了一些钝形特征点的遗漏的问题,这也是本研究的第二个创新点。

1 前言

1.1 课题研究背景及意义

获取准确的身份信息是当今世界一个非常重要和活跃的研究课题[1]。传统的身份信息包括身份证、密码、密钥、口令等,但这些都有一定的误认风险,因此假冒案件变得非常简单和频繁。在当前的危机形势下,生物特征安全的概念已被证明是最新和最有效的[2]。随着图像处理等技术的进步和发展,使具有高度特异性的人体特性在生物特征识别技术上有广泛应用。目前常用的生物识别技术主要包括人脸识别、指纹识别、掌纹识别、语音识别、视网膜识别等[3]。

由于人脸特征的多样性和复杂性,周围环境对其影响很大。且随着时间的改变,人脸会发生变化,且同卵双胞胎之间的面部特征差异非常小。指纹识别由于外部因素,指纹很容易变形,也有被复制的风险。掌纹识别与其他生物特征相比,掌纹特征不够明显,表现出高度的相似性。很难用有限的尺寸特征描述整个手掌,因此无法达到最高的识别度。语音识别是一种被广泛接受的非接触式识别技术,但人声是可变的,其变化范围很大,随着音量、速度和音质的变化而变化。与以上生物识别技术相比,视网膜识别:提取的视网膜生物特征主要是视网膜上的动脉、静脉和视网膜血管,它们以树状结构从视盘中心向外扩散。在视网膜识别过程中,通过计算机确定视网膜血管形态分布和分叉位置的差异,实现身份识别。

早在1935年,Simon和Goldstein首次表明视网膜血管对每个个体,甚至对双胞胎都是独特的[4]。由于视网膜位于在眼球最后端,不易受外界物理环境的影响产生变化,也不易发生形变或损伤,这使得使用视网膜识别算法的识别系统将比指纹识别、人脸识别等更安全和难以伪造。而且将更适合安全要求高的军事或国家政府部门。尽管视网膜具有这些优势,但由于眼底相机成本较高和图像采集困难,需要被拍摄者的眼睛看向特定角度,被拍摄者接受度低,所以商用推广性较低,因此未能被广泛使用。

1.2 国内外研究现状

与其他形式的生物特征验证相比,基于视网膜图像的认证系统的文献较少。现有的视网膜识别方法有两大类:基于细节点的匹配方法和基于非细节点的匹配方法。基于细节的匹配方法主要从分割后的视网膜血管中提取细节点进行图像匹配。这种匹配方法利用了视网膜血管的形态特征,不受光照和噪声的影响,但匹配算法耗时较长。基于非细节点的匹配方法主要包括基于图像整体特性的匹配方法和基于深度学习的匹配方法。这种匹配方法耗时较少,但随着图像亮度和角度的变化,匹配准确率迅速降低。

基于细点的匹配方法:这种方法由血管分割、特征生成和特征匹配三个主要模块组成。首先增强图像对比度,减少干扰的噪声。然后对血管进行分割,得到二值图像,然后将二值图像细化到一个像素宽度,提取特征,生成特征向量。用欧几里德距离、曼哈顿距离或马氏距离来度量测试图像与训练图像特征向量之间的距离,距离小于阈值认为匹配。

2010年Oinonen等人[5]提出了一种新的基于细节特征的验证方法。该方法包括三个步骤:血管分割、特征提取和特征匹配。在实验中,血管分割可被视为特征提取的预处理阶段。然后,获得血管交叉点及其方位信息。这些数据与对比图像中的相应数据相匹配。该方法使用血管方向信息来提高匹配的鲁棒性。但用于分割、特征提取和匹配的计算时间很长。2010年Lathal[6]提出了一种基于非可逆结构的视网膜生物模板认证方法,在分割过程中识别视网膜血管的节点,然后生成模板组成的分岔点的血管和模板转换使用不可逆转的建筑算法,最后以不同的模式匹配分岔点。该方法克服了图像可能会发生平移、旋转位移和血管非线性变形等变形问题。对三个数据库的图像进行识别,STARE数据库的识别率较低。

2 材料和方法

2.1数据库介绍

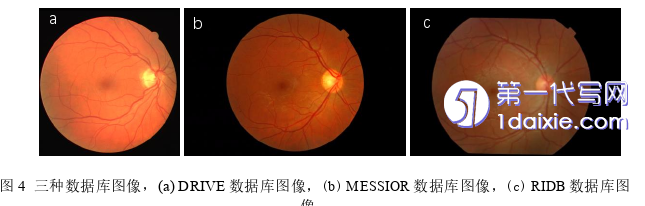

正常的视网膜图像都是由专业的眼底相机拍摄,以供后续的诊断和研究。国际上视网膜公开数据库多用于视网膜血管分割、身份识别和眼底疾病诊断等研究。不同机构获取的视网膜图像是有差别的,有的是正常健康的视网膜图像,有的是有视网膜病变的真实图像;另外,不同数据库中图像的采集仪器、角度、图像分辨率都是不同的,所以不同的数据库适用于不同的研究。常用于视网膜血管形态分割和识别的数据库包括 DRIVE[27]、MESSIDOR[28] 和RIDB[29]。 本文简要介绍这三个图像库如下:

2.1.1 DRIVE 数据库

DRIVE数据库是使用 Canon 非散瞳照相机拍摄,拍摄角度为 45 度,含 40 幅 RGB 格式的彩色视网膜图像,官方将其划分为20幅训练集,20幅测试集,包含专业医师分割的图像作为图像分割标签。该数据库中图像分辨率为 584×565,全部视觉区域为圆形,直径大约是540个像素,彩色图像有24比特,彩色眼底图像存储为 TIF 格式。如图4(a)所示。

2.1.2 MESSIDOR数据库

MESSIDOR视网膜数据库由法国国防部建立,也是目前开放的最大眼底图数据库,共有来自三个不同眼科机构的1200张眼底图。图像分辨率1440×960, 2304×1536 和2240×1488,彩色眼底图像以TIF格式保存。如图4(b)所示。

2.1.3 RIDB数据库

RIDB数据库为20个不同的个体,收集每人5张图像,共100张,分辨率为1504 × 1000的视网膜图像。每个个体的五张图像分别在不同的角度和光照下拍摄,能更好地模拟身份识别时拍摄的各种图像问题。彩色眼底图像存储为JPG格式。如图4(c)所示。

2.2本文算法设计

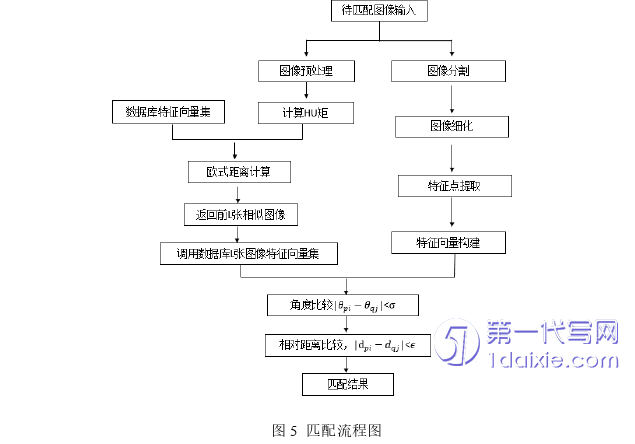

本文针对使用特征点匹配耗时长和使用图像特征匹配准确率低的问题,提出一种多特征的图像匹配算法,将视网膜血管形态特征和图像特征(HU矩)相结合,采用由粗到精的匹配方法实现图像识别。本文针对视网膜血管分割时血管末梢不易被分割出的问题,设计了一个基于改进U-Net网络的视网膜图像分割,实现了视网膜血管的准确分割。为了解决钝形特征点被错误去除的问题,使用自适应曲率阈值的CPDA角点检测方法,得到血管特征点。综合运用自适应阈值分割、迭代阈值等方法定位视盘和黄斑,用特征点、视盘和黄斑的相对位置构造了具有旋转不变性、尺度不变性的特征向量。将由特征点构成的特征向量和图像特征(HU矩)相结合,采用由粗到精的匹配方法实现图像识别。匹配流程图如下图5所示。

3系统软件页面设计 ................................ 19

3.1 平台环境 ............................. 19

3.2 软件需求分析 .......................... 19

4 实验结果与分析 ..................................... 23

4.1视网膜分割结果 ............................. 23

4.2 图像匹配结果 ................................. 25

5 讨论 ........................... 29

5 讨论

本章将进一步对实验结果进行讨论,在提取血管形态特征时,在基础的U-Net网络中使用新的W卷积模块代替传统卷积层,并引入了自注意力机制模块,增加了血管特征的权重,加强了网络提取特征的能力,可以更好地保留局部血管特征,使模型能更好的识别血管像素。如图17所示,本文算法比传统U-Net方法提取到更多血管细节特征对血管末梢细节有较好的分割效果,在视盘周围的血管分割中本文方法比滤波方法效果更优,避免了将视盘边界误分为血管。其分割结果为准确度95.8%,灵敏度78.1%,特异度98.2%,相比于其他算法在保证特异度的前提下,准确度和灵敏度有显著提升。

在特征点提取时,使用改进的自适应阈值的CPDA角点检测方法能够精确地检测特征点的位置,与预先设定好固定阈值的CPDA角点检测方法相比通过构建的自适应阈值函数避免了一些钝形特征点的遗漏的问题,当一些视网膜血管弯曲度较小时,通过自适应阈值也能很好地检测到,视网膜的形态特征会表示地更细致。通过去除血管中的小毛刺,使得血管更加光滑,减少了这些小毛刺造成的伪分叉点。当两个特征点距离极近的时候,为了避免一个特征点能匹配到两个点的情况,将两个极近的特征点合并为一个,取距两点欧氏距离最小的像素点为两点合并后的位置,通过此方法检测到的特征点可更好地应用于特征匹配。

6 结论

视网膜识别技术是一种安全有效地生物特征识别方法。为了解决网膜血管分割时血管末梢不易被分割和视盘边界易被误分为血管的问题,本文设计了改进的U-Net网络用来分割血管。使用自适应曲率的CPDA角点检测算法解决了钝形角点被错误去除的问题,检测到更准确、稳定的特征点,增加了匹配的准确率。考虑到识别精度与识别速度的问题,本文设计了一个基于多特征的匹配算法,将视网膜形态特征和图像HU特征相结合,由粗及精对图像进行匹配。使用视网膜视盘部分图像的HU矩特征实现粗匹配,使得能够缩小检索的范围,极大缩小了匹配时间;再利用视网膜血管的形态学特征构建旋转不变和尺度不变的特征向量进行精匹配,从而实现视网膜身份识别的结果。此匹配方法结合了细节点匹配和非细节点匹配的优点,极大提高了识别效率。本研究还设计了一种眼底图像采集与分析系统,具有采集、浏览、保存、分析、匹配图像的功能,用于视网膜图像识别。

参考文献(略)