本文是一篇计算机论文,笔者认为双流网络包含了两个独立的网络分支:空间流网络和时间流网络,分别从 RGB 图像和光流图像中提取特征,并通过后期融合得到最后的分类预测。传统的双流网络架构以二维卷积网络作为两个分支网络的特征提取器,在有限的时间感受野内(单帧RGB 图像或 10 帧的光流图像)提取特征,无法学习长时间尺度的运动信息;其次,传统双流网络中两个分支网络的训练独立进行,只在最后进行得分融合,无法学习时空特征之间的关联信息。

第一章 绪论

1.1 研究背景及其意义

视频由离散的图像序列组成,其帧率和分辨率越高,与所记录场景的相似度就越高,更能反映客观世界的真实变化。类似于人类通过视觉系统理解现实世界的变化,利用计算机理解视频中的空间和时间信息是计算机视觉研究的重要方向,而视频理解研究领域中最重要的任务之一就是理解人类的行为动作。视频动作识别通过分析视频中的时空信息,识别出给定人类动作的语义标签,是计算机视觉领域中的代表性任务之一,其在视频监控[1]、人机交互[2]、网络视频搜索[3]、医疗诊断[4]等许多的领域中都有着重要的应用价值。

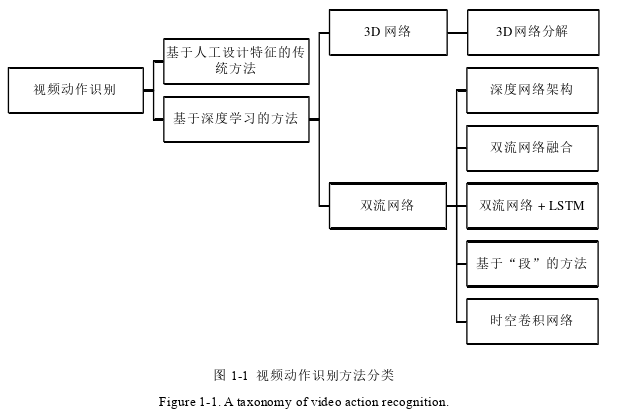

随着人工智能研究的不断发展,计算机视觉研究从传统的基于“特征工程”的方法转向基于深度学习的“网络工程”方法[5],通过利用深度神经网络自动地进行特征的提取和分类。传统的基于人工设计特征的方法计算开销巨大,通常用于解决简单的研究问题,对于复杂问题的泛化能力不强,不利于大规模数据特征的提取。而基于深度学习的方法通过从大规模数据中学习特征,大大减轻了人工设计特征的难度,成功地应用于许多的视觉识别任务中。视频动作识别方法也从传统的基于人工设计特征的方法转向基于深度学习的方法,以构建更有效的深度神经网络模型为导向。

深度学习技术在图像分析任务(如目标检测[6]、图像识别[7]等)中取得了显著的性能优势,产生的结果已经可以与人类的准确性相媲美。特别是在 2012 年 ImageNet 竞赛中 AlexNet 网络[8]出现之后,卷积神经网络在图像分析领域得到迅速的发展与应用。此后,提出了许多的卷积网络架构,旨在获得更高的性能、更快的计算速度或者更灵活的通用性。随着深度学习研究的迅速发展以及硬件设备性能的不断提高,研究人员开始将卷积神经网络应用于视频分析问题,视频动作识别研究越来越受到关注。

1.2 研究现状及其发展趋势

早期的视频动作识别研究中,由传统的基于人工设计特征的方法占主导地位。人工设计的特征,如稠密点轨迹(Dense point trajectories) [9]、改进的稠密轨迹(Improved Dense Trajectories, iDT)[10]等,由于其精确度高、鲁棒性好,在视频分析任务中应用广泛。然而,基于人工设计特征的方法计算开销巨大、对复杂问题的泛化能力不强,一般只适用于特定的、小规模的研究任务。

随着深度学习研究的迅速发展以及硬件设备性能的不断提高,计算机视觉领域的相关技术不断实现突破,产生的结果可以与人类的准确性相比较,甚至超过人类的水平。深度学习方法利用大规模的数据以及丰富的计算资源训练深度神经网络模型提取特征,在目标检测[6]、图像识别[7]和图像分割[11]等任务中都取得了显著的性能提升。随着大规模视频数据集的不断发布,基于深度学习的视频动作识别研究发展迅速,研究人员开始将卷积神经网络应用于视频分析问题。

第二章 视频动作识别概述

2.1 视频动作识别方法流程

通常意义上的视频动作识别任务分为检测(detection)和分类(calcification)两个子任务,检测任务定位视频中动作发生的时间区间,分类任务将视频归类为预定义的动作类别。但一般来说,目前广泛研究的视频动作识别(Video Action Recognition)指的是视频动作分类任务,即对已经剪辑好的视频片段按照预定义的动作类别进行分类。

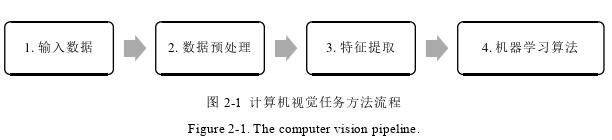

人类的视觉系统由传感器和解释器两个部分组成。计算机视觉研究中最重要的任务之一是模拟人类的视觉系统,感知周围环境,并相应地做出预测。计算机视觉的应用非常广泛,但通常和人类视觉系统的处理过程类似,通过相同的步骤流程来处理和分析图像数据,计算机视觉任务的方法流程一般为:(1)获取数据;(2)数据预处理;(3)特征提取;(4)预测分类。为了提高分类算法的准确度,通常在这些步骤上进行改进。例如,获取更多的训练数据、使用更有效的预处理方法去除噪声、通过人工设计或深度神经网络提取有效的特征、改进分类算法。

2.2 视频动作识别数据集

深度学习方法的准确性通常随着训练数据量的增长而提高,在视频动作识别研究中,通常存在大量的动作类型和可能的执行方式,需要大规模带标注的数据集来训练深度神经网络模型。近年来发布的视频动作识别数据集的视频数量和类别数目都在快速增长,同时新数据集的发布速度也在不断提高。大规模、高质量的视频数据集的出现驱动了视频动作识别研究的发展,其研究越来越受到人们的关注。

视频动作识别数据集的内容范围通常包含了人类的日常行为活动、电影、监控、体育赛事等场景下的人与人之间或人与物之间的互动。视频动作识别数据集的构造过程一般有 4 个阶段:(1)定义数据集中所要收纳的动作类别列表,通常在原有数据集的基础上添加新的动作类别;(2)获取视频,并将视频匹配动作类别标签,通常视频来源于视频门户网站,如 YouTube、Google 视频等;(3)标注视频中动作开始和结束的时刻,通常由人工手动完成;(4)清理数据集,去除重复或带有噪音的视频样本。

值得注意的是,由于版权和隐私方面的问题,Kinetics 数据集只提供了视频链接供用户下载,而不是实际的视频资源。这种情况造成的影响是:一方面,数据集中的视频链接平均每年以 5%的速度失效。以 Kinetics400 为例,数据集发布时包含 306K 个视频片段,但目前仅能抓取约 260K 个视频[12]。另一方面,视频网站对个人用户大规模的下载操作也存在限制。这些限制使得研究人员下载完整的数据集是缓慢甚至不太可能的,造成无法基于统一的数据集进行有效公平的比较。

第三章 基于残差缩放和加法交互的视频动作识别方法 .......................... 30

3.1 引言 .......................... 30

3.2 视频动作识别网络模型设计 ............................... 30

第四章 基于恒等映射和乘法交互的视频动作识别方法 ................................ 53

4.1 引言 ............................... 53

4.2 视频动作识别网络模型设计 ............................... 53

第五章 总结与展望 ................................. 65

5.1 本文总结 .................................... 65

5.2 未来展望 .................................. 66

第四章 基于恒等映射和乘法交互的视频动作识别方法

4.1 引言

上一章中,采用 ResNet 作为基础网络构建了双流网络模型,并对传统的双流网络架构进行了改进:首先,通过构建基于残差缩放的时空残差网络,扩展了网络的时间感受野;其次,通过引入加法交互,实现了双流网络中时空特征的交互融合。

本章针对传统双流网络架构对时空信息建模能力的不足,采用 ResNeXt 网络作为基础网络模型,使用新的方法对传统双流网络结构进行了改进,具体内容如下:

针对视频长时间序列的建模问题,本章通过构建基于恒等映射的时空残差网络,将二维空间网络扩展到三维时空域,以扩展网络的时序信息建模能力。方法通过将一维的时间卷积初始化为特征级别的恒等映射,直接将时间卷积层添加到残差单元的残差路径中构建时序连接,再通过后续的学习学得时序关系。通过这种方式,时间卷积层的添加不会对预训练好的网络的信息流造成干扰,同时保留了残差网络的特征恒等属性。

针对双流网络中时空特征的交互问题,本章通过引入乘法交互策略,在多个抽象尺度上实现了双流网络的融合。在上一章研究的基础上,通过构建基于残差连接的乘法交互,将跨流融合方式从一阶扩展到二阶,进一步完善了时空特征的交互方式。 最后,在基准数据集 UCF101 和 HMDB51 上对本章提出的改进策略进行了实验及评估。实验结果表明,本章中所采用的方法能够进一步改善网络对时空信息的建模能力,有效提升网络的识别性能。

第五章 总结与展望

5.1 本文总结

本文研究了基于双流网络的视频动作识别方法,对传统的双流网络架构[24]的设计不足进行了研究,提出了两种方法对传统的双流网络结构进行了改进。 双流网络包含了两个独立的网络分支:空间流网络和时间流网络,分别从 RGB 图像和光流图像中提取特征,并通过后期融合得到最后的分类预测。传统的双流网络架构以二维卷积网络作为两个分支网络的特征提取器,在有限的时间感受野内(单帧RGB 图像或 10 帧的光流图像)提取特征,无法学习长时间尺度的运动信息;其次,传统双流网络中两个分支网络的训练独立进行,只在最后进行得分融合,无法学习时空特征之间的关联信息。为此,本文基于双流网络架构,研究了视频长时序建模和双流网络时空特征交互的问题。

针对视频长时序的建模问题,本文研究了将二维深度残差网络扩展为三维结构的方法,提出了两种时空残差网络构建双流网络模型,以扩展网络的时间感受野:基于残差缩放的时空残差网络(3.2.1 节),基于恒等映射的时空残差网络(4.2.1 节)。方法采用两种方式构造时空残差单元,利用一维的时间卷积构建局部的时序连接:基于残差缩放的时空残差单元在一维的时间卷积层后添加残差缩放层,将时间残差缩放后添加到残差路径当中,以稳定网络的训练;基于恒等映射的时空残差单元通过将时间卷积初始化为特征级别的恒等映射,直接将一维时间卷积添加到残差路径当中。然后,通过构建多个时空残差单元的叠加,随着网络深度的增加,实现对长时间尺度运动信息的建模。

对本文提出的两种时空残差网络,在 UCF101 和 HMDB51 数据集上进行了实验,比较了不同的构造方式以及时间卷积核的初始化方法对网络模型性能的影响。实验结果表明,本文提出的两种构建时空残差网络的方法能够对视频长时间序列进行有效的建模,相比较传统的双流网络结构,有效提升了网络的识别性能;对于基于双流网络的视频动作识别方法,在以不同模态数据(RGB 或光流)作为输入的两个分支网络中,对长时序信息的建模都是关键的;对于视频动作识别任务,相比较局部的时空特征,利用全局时空特征进行动作分类任务更加有效。

参考文献(略)