本文是一篇计算机论文,本论文聚焦于低资源场景下多模态预训练模型的适配问题,针对当前视觉-语言预训练模型(如CLIP)在细粒度分类、零样本与少样本任务中存在的语义模糊性和数据不足挑战,分别提出了基于文本增强的方法、基于生成图像的方法和基于层级一致性约束的方法。

第1章绪论

1.1研究目的与意义

1.1.1研究的背景

近年以来,在人工智能技术快速更新迭代的大背景下,计算机硬件性能提升和硬件系统的更新为前沿技术落地提供了必要保障。云端服务器集群和移动终端的算力提升,使得深度学习模型可以在复杂场景中进行规模化部署。特别是在图像识别、自然语言处理等领域有着卓越表现的深度学习技术,由于其在各项互联网应用中的卓越性能,受到了科技研究领域和工业生产领域的广泛关注。在云端计算领域,分布式训练框架与高性能GPU集群使得千亿参数模型的训练成为可能;在终端设备侧,专用AI芯片(如NPU、TPU)的普及显著提升了边缘计算的实时性。这种硬件与算法的协同进步,推动深度学习技术在视觉理解、自然语言处理、多模态交互等领域的应用进入成熟期。以计算机视觉为例,基于卷积神经网络(CNN[1])的目标检测算法在COCO[2]数据集上的平均精度(mAP)已从2015年的24%提升至现如今的65%以上,而Transformer[3]架构的引入更是突破了传统CNN对长距离依赖建模的局限。

随着科研领域的持续深化研究以及全球科技企业的资源倾斜,当前深度学习技术在语义分析、图像分类、图像生成等方向已形成成熟技术路径。针对常规场景需求,开发者只需要通过查找并调用开源算法库,结合目标场景的针对性数据采集与标注处理,经过模型参数调优后通常可获得满足业务要求的智能解决方案。随着开源生态的完善(如PyTorch[4]、TensorFlow[5]框架),针对常见任务(如图像分类、文本情感分析)的解决方案已形成标准化流程:选择预训练模型架构→采集领域相关数据→进行数据标注→微调模型参数。这种模式在通用场景中取得了显著成效,例如基于ResNet-50[6]的微调模型在ImageNet[7]数据集上仅需1%的标注数据即可达到80%以上的分类准确率。

1.2国内外研究现状

近年来,多模态预训练模型在计算机视觉与自然语言处理领域快速崛起。它们通过对大规模图–文对的联合学习,构建了一个通用的跨模态语义空间,为零样本、少样本学习提供了全新途径。但实际应用中,当数据资源受限或任务语义复杂时,已有方法依然面临诸多挑战。以下从两个层面进行概述:一是多模态预训练模型的发展,二是基于预训练模型的适配策略。

1.2.1多模态预训练模型的发展

在此背景下,预训练-微调(Pre-training&Fine-tuning)范式成为突破数据瓶颈的关键技术路径。其基本思路是先利用大规模无监督或弱监督学习来构建一个通用的特征表示,随后采用轻量化调优策略实现下游任务适配。技术体系最初在Transformer架构驱动的自然语言理解领域取得突破——得益于语言结构的统一性特征及上下文依赖性规律,基于大规模无标注语料库的全局表征学习可使基座模型精准捕捉语言系统的潜在分布特性。通过在海量文本上学习通用语言模式,使模型即便仅借助少量标注数据,也能高效适配多种语言任务如理解与生成。

在自然语言处理领域,早期的预训练模型如GPT[12]和BERT[8]取得了显著的突破,这些模型主要采用无监督学习方法进行训练。2018年提出的BERT[8]模型通过掩码语言建模(MLM)[8]任务,在110种语言、数十亿文本语料上预训练,仅需添加任务特定层即可在GLUE[9]基准测试中超越传统方法11.7个百分点。这种范式变革迅速蔓延至计算机视觉领域,催生了以CLIP(ContrastiveLanguage-Image Pretraining)[10]、DINO[11]为代表的视觉-语言多模态预训练模型,标志着人工智能从单模态理解向跨模态推理的范式跃迁。

第2章基于文本数据增强的零样本图像分类

2.1引言

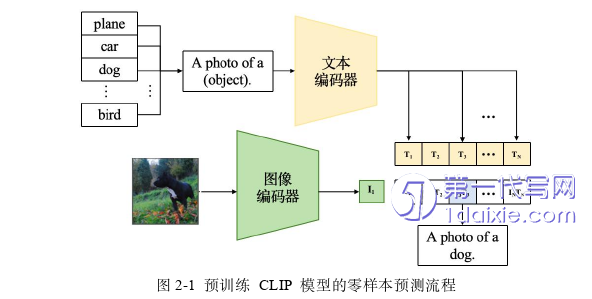

视觉-语言多模态预训练模型CLIP通过对比学习构建了跨模态的联合语义空间,其核心由图像编码器与文本编码器构成。图像编码器可基于ResNet或Vision Transformer(ViT)架构提取视觉特征,而文本编码器采用Transformer模型处理自然语言,两者通过海量互联网图文对(如4亿规模的WIT数据集)进行联合训练,目标是通过对比损失函数最大化匹配图文对的相似度,同时最小化非匹配对的关联性。这种设计使得CLIP能够实现图像与文本的语义对齐,并为零样本分类任务提供基础支持。在零样本分类场景中,CLIP通过将类别名称嵌入到特定文本模板(如“a photo of a[CLASS]”)生成类别语义特征,并与图像特征计算余弦相似度完成分类,如图2-1所示。但是文本模板设计的敏感性显著影响模型性能。以卫星遥感数据集EuroSAT为例,采用“A photo of a[CLASS]”固定文本模板的准确率和采用更加贴切卫星遥感描述的定制模版的准确率进行对比,例如采用“a centered satellite photo of[CLASS]”这一定制模板时,较特定文本模板的准确率提升幅度超过15%。这一现象源于领域特异性语境对文本编码的优化作用:特定模板能够引导文本编码器生成更贴合任务语义的特征表示,从而缩小视觉-语言模态间的领域鸿沟。然而,人工设计模板存在两大局限:一是泛化性不足,不同任务需定制化模板(如医疗影像需强调解剖结构,商品分类需突出材质属性),设计成本高昂;二是信息冗余,单一模板难以覆盖类别的多维度语义,例如“斑马”需同时表达“动物”“条纹”“非洲草原”等关联概念。

2.2文本训练数据的准备

为了在图像分类任务中提升模型对目标类别的识别能力,特别是在多标签分类场景下,本文设计了一种高效的文本数据构建方法。该方法旨在生成数量充足且语义多样的类别描述文本,以支持模型的训练和优化。首先,确保文本描述全面覆盖下游数据集中的所有目标类别是关键。为此,本文选取了OpenImage V6[47]数据集中的Localized Narratives作为文本来源,该数据集提供了丰富的图像描述信息,适用于多标签分类基准测试数据集如Pascal VOC2007[45]、MS-COCO2014[34]和NUS-WIDE[46]。

然而,直接使用类别名称进行文本检索可能会遗漏大量相关描述,因为自然语言中同一类别可能有多种表达方式。为解决这一问题,本文引入了同义词扩展策略。具体而言,利用WordNet等词汇资源,为每个目标类别构建包含其同义词的词典。例如,对于“dog”类别,词典可能包括“puppy”“doggy”等同义词。通过这种方式,可以捕捉到更广泛的相关描述,可以对文本数据的丰富性进行增强。

为实现细粒度分类模型的鲁棒性,类别语义表征需满足双重约束:其一需确保语义覆盖的完整性,即下游任务涉及的每个目标类别需对应充分且精准的自然语言描述,这对模型建立可泛化的类别概念映射至关重要;其二需保证描述内容的异构性,通过引入多维度特征(如语境差异、句法变体、跨语言表述)增强文本表征的多样性,从而提升模型的抗过拟合能力。为确保方法可复现,本研究提出标准化数据构建方案:整合现有公开数据集中的目标类别描述,采用自动化筛选与清洗流程(如正则匹配、语义聚类)构建高质量语料库,通过模块化数据接口支持快速适配不同应用场景,对于常用的多标签分类基准测试数据集PascalVOC2007[45]、MS-COCO2014[34]、NUS-WIDE[46],本文使用OpenImage V6[47]数据集中的局部化描述(Localized narratives)作为文本来源。

第3章基于生成图像的图像分类提示学习........................22

3.1引言...........................................22

3.2生成图像数据构建............................22

第4章基于类别层级一致性的提示学习................................35

4.1引言................................35

4.2基于类别层级一致性的提示学习架构...........................36

结论...............................47

第4章基于类别层级一致性的提示学习

4.1引言

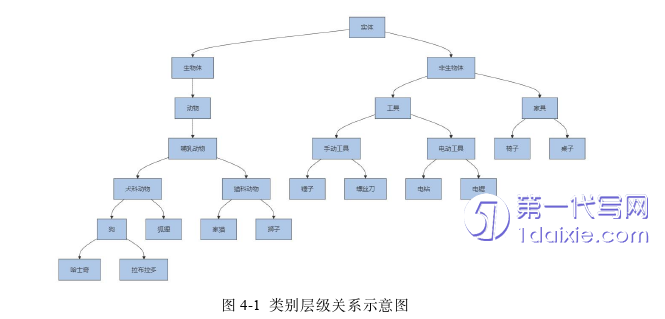

本课题在第三章中提出了一种基于生成图像的提示学习方法,通过利用GPT-4o构建语义丰富的文本提示,引导Stable Diffusion生成高质量图像,并结合CLIP模型在生成图像数据上进行提示微调,从而提升图像分类性能。该方法尤其适用于低资源和零样本分类场景,显著增强了模型对视觉语义的感知与判别能力。然而,在多类别分类场景中,类别之间往往存在固有的层级结构与语义关系,特别是在如ImageNet、MS-COCO等数据集中,类别常常以超类与子类的形式嵌套,如图4-1所示。忽略这种层级信息可能导致分类缺乏必要的结构约束,从而引发语义冲突或预测不一致的问题。例如,CLIP在零样本分类中通常依赖单一类别名称(如“工具”)生成文本嵌入,但过于宽泛的标签容易出现语义覆盖不足或视觉特征混淆(例如,“工具”既可指手动工具如锤子,也可指软件工具如IDE,二者的视觉特征差距极大)。此外,合理利用类别层级关系有助于缓解零样本分布偏移问题,因为CLIP的预训练数据不可能涵盖所有下游任务的语义范围;在某些情况下,预测类别的父类(如“有袋动物”或“哺乳动物”)可能比直接预测具体子类(如“考拉”)更为可靠。同时,层级信息还能减轻长尾类别失效的问题:对于稀有子类(如“哈士奇”)由于训练样本稀缺而预测置信度较低,通过预测更广义的父类(如“犬科”或“动物”)可以获得更稳定的表现。

结论

本文主要研究了在低资源场景下多模态预训练模型应用于图像分类任务的问题。随着深度学习和大数据技术的不断发展,预训练模型可以很好地处理多模态任务。但是,实际应用中面对细粒度分类、零样本和少样本等情况时,预训练模型仍然存在语义模糊、类别边界不够清晰以及长尾分布不均等问题。而且由于传统的零样本分类方法通常依赖于简单的固定文本模板,这种方法难以充分表达出类别内部的多样性及类别间复杂的层次关系,导致在处理领域差异比较大或者语义复杂的任务时效果不尽如人意。针对上述问题,本论文提出了一种全新的解决方案。本文从文本增强、图像生成、层级一致性三方面提出了解决策略。

第二章中,本文提出的基于文本数据增强的图像分类方法显著提升了零样本预训练模型的效果。本章通过大语言模型GPT-4o对现有文本数据的类别标签进行上下文扩充,生成多样化且语义丰富的文本描述,经过实验验证GPT-4o生成的语义文本可以有效地扩展语义覆盖、提升分类准确性。这些描述不仅包含目标对象的基本特征,还融入了场景、属性及背景信息,从而构建了一个多模态语义原型库。这些文本数据通过CLIP模型的文本编码器处理后,再采用提示微调技术进行参数更新,模型可以在完全不依赖真实图像数据的情况下,实现零样本图像分类准确率的大幅提升,同时通过全局-局部双分支提示设计提高了模型对整体与细粒度语义的捕捉能力。

第三章中,本文提出基于生成图像的图像分类提示学习的方法明显优化了零样本和少样本预训练模型分类的效果。本文首先通过GPT-4o对类别标签进行语义扩充,并利用Stable Diffusion v2生成高质量、多样化的图像数据,这些生成图像能够在视觉上充分展现类别的丰富特征。随后,本文基于生成图像对预训练模型进行提示微调,即将固定的提示上下文完全参数化,并利用生成图像数据对提示向量进行微调。与已有提示微调方法(如CoOp)不同的是,此处所使用的数据全部来源于生成图像,而非真实图像,因此更能适应低资源场景下的预训练模型适配问题。实验结果表明,在零样本和少样本任务中,基于生成图像数据进行提示微调能有效提升CLIP模型的图像分类性能,多项基准数据集的准确率均较基线方法有明显提高。同时通过消融实验,验证了文本增广、多样化生成图像以及提示微调策略各模块对模型性能的关键影响。

参考文献(略)