本文是一篇计算机论文,论文通过不同方式考虑数据与簇间、数据与数据间、簇与簇间的关系,提出两种算法,超越了单个样本信息,探索样本间关系,利用对比学习获得聚类友好型表示以提升深度聚类算法的效率。

第1章 绪论

1.1 研究背景与意义

随着科技的不断发展,大数据时代产生的信息出现爆炸式增长,涌现出许多大批量数据。当数据达到一定的规模时,有价值的信息便被蕴藏在大量毫无规律且类型不一的低价值数据当中。由于数据的数量和复杂性在不断增加,数据分析成为一项艰巨的任务。面对具有多样性和复杂性的海量数据,如何快速从中挖掘出符合需求并对人们有价值的隐藏信息是当前需要解决的重要问题之一。

聚类是数据挖掘中的重要方法之一,其应用广泛并且具有重要地位。聚类是以无监督学习方式在数据集中寻找“自然分组”的技术,通过寻找各数据之间的潜在联系将它们划分为有意义的群组,同一群组内数据具有较高的相似性,不同群组之间具有较低的相似性。因此,聚类往往是数据挖掘任务中的一个重要预处理步骤,可以帮助分析和描述未知信息,是对样本进行标签化处理的常用方式。聚类被广泛用于商业研究、文本分析、生物医学、工业、信息安全等各个方面,通过聚类分析对事物特征进行共性研究,从而获取有价值的类簇信息。在文本分析中,聚类分析能对相关文档进行汇总,既方便对文档进行归类统计,又能提高文档检索时的准确性,给用户带来较好的使用体验[1];在计算机视觉领域,对图像数据的初步处理和划分是必不可少的基础步骤,其中最为常见的是使用聚类算法,根据像素特征划分图像数据,使得同一类中图像具有高相似度的像素特征。

1.2 国内外文献综述

由于数据表示的质量在很大程度上决定了聚类的性能,因此,如何利用神经网络来学习聚类友好表示,提高聚类性能成为无监督学习领域的研究热点。深度聚类是一系列采用深度神经网络学习聚类友好表示的聚类方法,重点在于学习面向聚类的表示。深度聚类多使用神经网络的“主分支”将输入转换为用于聚类的潜在表示,并将这些表示作为特定聚类方法的输入进行后续聚类,其动机是利用深度神经网络逼近非线性函数的能力保持联合优化中两个任务的优势。因此深度聚类损失函数通常包括网络损失与聚类损失,通过两种损失的联合训练使数据变得更具辨别力并形成集群。

从深度神经网络体系结构角度出发,本章将主要的深度聚类算法分为三大部分进行介绍:基于自编码器的深度聚类算法、基于生成式网络的深度聚类算法和基于孪生网络的深度聚类算法。孪生网络在深度聚类的使用中主要是与对比学习相结合,因此第三部分主要对基于对比学习的深度聚类算法做介绍。

1.2.1 基于自编码器的深度聚类算法

基于自编码器(Auto-Encoder,AE)的深度聚类算法通过自编码器直接学习特征表示,由于自编码器几乎可以与所有聚类算法相结合,因此基于自编码器的深度聚类算法是最常见、应用最为广泛的。自编码器存在各种变体,可将自编码器加入噪声形成去噪自编码器,也可将自编码器与卷积神经网络相结合形成卷积自编码器等。

第2章 基础理论与预备知识

2.1 深度聚类相关概念

聚类按照某个特定标准将数据集划分为不同的集群,将相似的数据划分到一起,使同一集群内数据相似度尽可能高,不同集群中数据的相似度尽可能低。

表示学习为了提高机器学习的准确率,将输入信息转换为有效的特征或者更一般性的表示。基本思路是从原始数据中学习出有效的特征,提高机器学习模型的最终性能,即找到对于原始数据更好地表达,以方便后续任务。

深度聚类是使用深度神经网络同时学习特征表示和聚类分配的一系列方法。对表示学习与聚类进行联合优化,通过训练将数据转换为更有利于聚类表示的非线性映射。

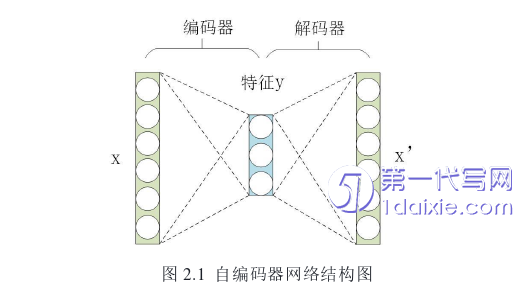

2.2 自编码器

自编码器[38](Auto-Encoder,AE)是广泛使用的无监督表示学习方法之一。其基本思想是利用一层或多层神经网络对输入数据进行映射,映射后的向量是从数据中提取的重要特征,用于后续学习。为保证映射向量包含更为本质的特征,AE通过该向量对输入进行重构,希望重构后的输出与输入尽可能相等。

基本自编码器模型是一个三层神经网络结构,分别为一个输入层,一个隐藏层与一个输出层,输入层与输出层的维数相同,令输入输出尽可能一致。

AE一旦训练完成后,解码器部分将不再使用,此时编码器可以得到较好的特征表示,将编码器用于对数据进行映射。由于自编码器原理易于理解,操作简单并且可与大部分算法相结合,因此在深度聚类算法中被广泛使用。其中,出现了许多自编码器的变体以提高自编码器的性能:

(1)堆叠自编码器[38]:该编码器为最常见的自编码器之一,本质上是增加编码器与解码器的层数,使用更深层的网络结构,有利于学习到更优的表示。通常使用的自编码器都是堆叠自编码器。

(2)卷积自编码器[38]:原始自编码器的编码层与解码层都是简单的全连接层,可以将其进行变化,例如变换为卷积层、池化层等,构建成为卷积自编码器,有利于对图像数据进行特征提取。

第3章 基于自步学习的实例级别对比聚类研究 .............................. 19

3.1 算法思想与框架概述 ................................ 19

3.2 基于自步学习的实例级别对比聚类算法 ................................ 20

第4章 基于图结构的实例-簇级别对比聚类研究 ................................. 33

4.1 算法思想与框架概述 ......................................... 33

4.2 基于图结构的实例-簇级别对比聚类算法 ........................... 34

第5章 总结与展望 ....................................... 46

5.1 总结 ..................................................... 46

5.2 展望 ........................................... 47

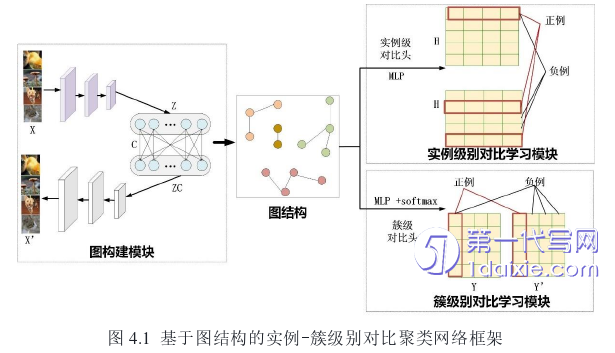

第4章 基于图结构的实例-簇级别对比聚类研究

4.1 算法思想与框架概述

为学习到较好的特征表示,论文选择将对比学习应用于深度聚类,有研究者直接使用对比学习中的增强样本,遵循对比学习基本框架,只假设同一数据的增强样本在特征空间中应该是相似的,忽略聚类任务的本质,过分依赖于数据增强。但由于不同数据集的复杂性,通常采用的几种数据增强方式是否适合于所有的数据集是不确定的,并且大量利用数据增强会导致原始数据的利用不充分,因此过分强调数据增强可能会影响最终的结果。本章算法充分利用原始数据,通过考虑数据与数据、簇与簇间的关系构造对比学习中的正负例以学习聚类友好型表示,将其与深度聚类相结合。图作为重要的数据结构之一,被广泛应用于社交网络、推荐系统等方面,该算法超越单个实例,通过图结构发现数据中的局部结构关系并将其集成到对比学习中确定实例的分组。以聚类为导向从实例级别与簇级别分别进行对比学习,提高聚类性能,得到良好的聚类效果。

该算法主要采用深度子空间聚类网络思想,在自编码器中加入自表达层进行图结构的学习,之后连接两个不同的对比头——实例级别对比头与簇级别对比头,由簇级别对比头得到最终聚类结果。算法假设一个簇中的样本应该共享相似的特征表示和簇分配,将常用的实例级别提升到簇级别,从两个角度进行双重对比学习,同时学习聚类友好型表示与聚类。

第5章 总结与展望

5.1 总结

面对大量毫无规律且类型混杂的数据,快速从中挖掘出有价值的信息和规律是关注的重要问题之一。聚类以无监督方式将数据进行分组,是数据挖掘中重要的方法,被广泛应用于各方面的研究。深度聚类利用神经网络对数据进行表示学习,因此聚类性能在很大程度上取决于数据表示的质量。已有工作将对比学习与深度聚类算法相结合,但此类方法遵循对比学习基本框架,只假设样本与其增强样本在特征空间中是相似的,单纯使用对比学习做前期的表示学习,忽略了聚类任务的潜在信息,使用固定的损失函数,而不是专门面向聚类任务。本文在将对比学习应用于深度聚类以学习良好表示的基础上,提取有效的、聚类友好型表示,高效进行聚类与表示学习,提高深度聚类的性能。论文通过不同方式考虑数据与簇间、数据与数据间、簇与簇间的关系,提出两种算法,超越了单个样本信息,探索样本间关系,利用对比学习获得聚类友好型表示以提升深度聚类算法的效率。所提算法总结如下 :

(1)基于自步学习的实例级别对比聚类算法

该算法引入了自步学习的思想,分为两阶段通过由简到难的方式对数据进行训练。在第一阶段得到的初始特征空间中将容易区分的数据进行初步聚类。第一阶段通过考虑数据与簇之间的关系,采用中心损失对神经网络进行训练,该过程中将易分数据进行了初步聚类,同时在训练中学习到数据的成对相似性为后续过程进行监督。第一阶段完成后,数据被映射到一个初始的潜在空间,在该空间内易分的数据分布在相应的簇中心附近。

第二阶段在训练的同时使难分的数据逐渐变得容易区分,最后聚类到合适的簇中。具体来说根据第一阶段学到的数据间关系设定正负例,从而采用对比学习进行微调训练,对特征空间进行改进。在第二阶段的训练中,随着训练时间的增加,越来越多的难分样本逐渐变得容易区分,最后得到聚类结果。

参考文献(略)