本文是一篇计算机论文,本文在MiniImagenet与CIFAR-FS公开数据集上进行实验,验证了本文提出方法的可行性和有效性。此外,本文设计并实现一种基于元学习的图像识别系统。该系统使在云端训练元模型,在边缘节点进行本地推理,以节省云端计算资源,降低延迟。

第一章 绪论

1.1研究背景及意义

随着大数据时代的到来,深度学习技术利用大数据在图像分类、语音识别等领域大放异彩。这些技术需要大量带标注的高质量数据,但在某些现实场景中,有些类别只有少量数据或少量标注样本数据。于是,Li等[1]提出了少样本学习(few-shot learning, FSL)。FSL的目标是设计一个只需少量样例就可以快速认知新任务的模型。但基于梯度下降的优化算法在应用于少样本学习时会失效,其可能的原因有[2]:少样本学习问题的训练数据量较小,在模型训练中参数更新次数受到限制,传统的基于梯度优化的算法(例如ADAM[3],Adagrad[4]等)无法在这种情况下寻找到最优参数;对于每个数据集,网络参数必须从随机初始化开始,影响了优化速度。为缓解上述问题,赵等[5]总结了基于模型微调[6]、基于数据增强[7-9]和基于迁移学习[10-12]的三大类方法。其中迁移学习的主要思想是利用旧知识来学习新知识,并能将已经学会的知识很快地迁移到一个新的领域中。迁移学习需要源领域和目标领域存在一定关联,能实现知识在不同领域之间的迁移,因此成为目前主流的应用选择之一。

元学习(Meta-Learning)是基于迁移学习的一种解决方案,目的是“学会学习”(Learning to Learn)[13]。它希望从大量相似的小任务中学习一些元知识,并使用这些元知识来指导模型快速适应新任务。一些元学习算法在少样本学习中取得不错的成绩,例如Finn等[14]在2017年提出的模型无关元学习算法(Model-Agnostic Meta-Learning, MAML)。MAML算法以神经网络为基础模型,在大量相似任务上进行元学习,以找到对各任务较为通用的初始化参数,即训练得到元模型。当新任务来临时,仅用少量标注训练样本微调元模型,便可让损失函数快速收敛,以使模型适应新的学习任务。MAML不仅可以用于解决少样本分类问题,还可用于强化学习、回归等问题。

1.2国内外研究现状

Miken等[22]将元学习分为三类:基于度量,基于模型和基于优化的元学习算法。

1.2.1基于度量的元学习算法

基于度量的元学习算法学习的是度量函数。度量学习也称为相似度学习,是指通过给定的距离函数计算两个样本之间的距离,从而度量它们的相似度[23]。

Koch等[24]在2015年提出使用孪生神经网络(Siamese Neural Networks)进行单样本图像识别。孪生神经网络是一种相似性度量模型,目的是从数据中学习度量,进而利用学习到的度量来比较和匹配未知类别的样本。孪生神经网络定义了共享一套参数和权重的两个神经网络,并使用简单的距离函数计算一对样本的相似度。在训练阶段,通过最小化同类样本之间的距离、最大化不同类样本间距离的方式优化孪生神经网络。在测试阶段,将测试集中的每个待预测样本与已知的N类标注样本分别配对构成N对样本对,并将每对样本输入到孪生网络中,就能计算出每对的测试样本与N个已知标注样本的距离,距离最小的那一对中的已知标注样本的标签便作为测试样本的类别。

在单样本学习领域,Vinyals[25]等人提出的匹配网络(Matching Network)引入注意力机制计算目标样本与已知标注样本之间的相似度。通过注意力机制,可以综合考虑到待测试样本和支持集中所有样本的相似性。同时,在训练阶段,Vinyals要求支撑集和查询集必须是独立同分布,训练过程和测试过程应在同样条件下进行,这使得模型可以学习不同任务中的共性部分,从而提高模型的泛化性能。

上述方法都是解决单样本学习问题。为进一步深入研究少样本问题,Snell等人在2017年提出原型网络(Prototypical Networks)[26]。原型网络基于这样一个假设:在数据样本空间里,对于不同类别的样本,他们都存在一个原型点。若一个样本距离某个原型点越近,则该样本的标签与该原型点对应的标签相同的概率越大。原型网络使用深度神经网络将输入样本映射为特征向量,并将同一类别的样本特征向量的平均值作为该类别的原型。随着训练的进行,在向量空间内同一类别的样本特征向量与该类原型的距离不断缩小。当一个待预测的样本到来,根据其映射的特征向量与每个类别原型之间的距离确定其类别。但Ren等[20]认为,由于少样本问题中标注样本稀少,其得到的原型不一定准确,从而导致分类边界的偏差,所以Ren在训练阶段加入未标注样本辅助原型网络的训练,修正类别原型点,能够更准确的找到分类边界。

第二章 半监督学习和对抗学习

2.1半监督学习

半监督学习允许利用标注数据与未标注数据共同训练模型。半监督学习依赖三种假设:聚类假设、平滑假设、流形假设。

2.1.1 聚类假设

聚类假设[43](Cluster Assumption)指的是位于同一类簇的样本大概率属于同一类别。聚类假设也可以用另外一种等价的表达方式,即低密度假设(Low-density Assumption):分类器的决策边界不应通过边缘数据分布的高密度区域。因为若决策边界穿过数据密集的区域,则可能会将一个簇类中的数据分为不同的类别,这与聚类假设是矛盾的。

半监督支持向量机[43](S3VM)是支持向量机在半监督学习上的推广。支持向量机(Support Vector Machine, SVM)是一种二分类模型,利用经验风险(empirical risk)和结构风险(structural risk)来分类,目标是寻找一个超平面对样本数据进行分割,分割的原则是确保分类最优化,即类别之间的间隔最大。相较于寻找出最大间隔的支持向量机,S3VM试图通过探索未标注数据来规范、调整决策边界,找到能将两类有标记样本分开且穿过数据低密度区域的划分超平面。S3VMs更偏向于将未标注数据尽可能的推离决策边界,这与低密度假设相符。

SVMs和S3VMs不是概率模型,也就是说他们不是通过计算类的后验概率来进行分类的。在统计机器学习中,有很多概率模型是通过计算p(y|x)来进行分类的。对于这些概率模型,可以通过熵正则化[44](entropy regularization)方法将监督学习扩展为半监督学习。

2.2 对抗学习

深度学习的发展为生活带来巨大的改变,但人们也越来越关注这些技术背后的安全问题,例如人脸识别系统中的照片攻击、假体攻击等。因此,随着人工智能的发展,具有攻击性的对抗样本生成技术备受人们的关注。

2.2.1 对抗样本生成方法

神经网络模型极易受到对抗样本的攻击,Szegedy[50]通过在图像上增加微小的扰动导致模型对图像的错误分类。Goodfellow等[51]也表明在训练期间增加对抗样本可以提高神经网络模型的对抗鲁棒性。其采用的对抗样本生成算法为快速梯度符号算法(Fast Gradient Sign Method, FGSM)。

除FGSM算法外,投影梯度下降算法(Projected Gradient Descent Attack, PGD)也已被证明是对抗训练中最有效的算法之一[52]。PGD在干净样本的邻域范围内加上随机扰动,并将扰动后的样本作为算法初始输入,然后沿着梯度增加的方向进行多步小扰动,在每一小步后,重新计算梯度方向。相比FGSM,这能构造出更加精准的扰动,但代价是计算量的增大。

第三章 一种半监督对抗鲁棒模型无关元学习方法 ........................... 18

3.1正则化项设计 .............................................. 18

3.1.1 对抗鲁棒正则化项 ................................... 18

3.1.2 任务无偏熵正则化项 ....................................... 19

第四章 基于动态焦点损失的半监督对抗元学习算法 .................................. 30

4.1 难分类任务和易分类任务 ................................. 30

4.2V 焦点损失 ................................... 30

第五章 基于元学习的图像识别系统实现 ................................ 38

5.1应用需求 ......................................... 38

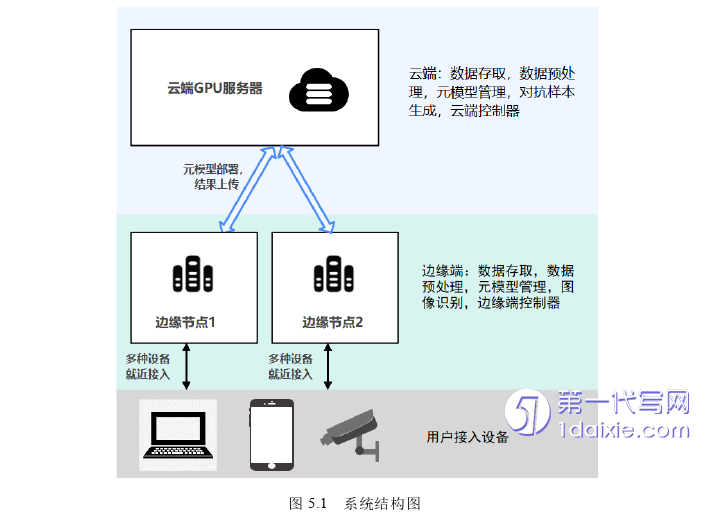

5.2系统结构 ...................................... 39

第五章 基于元学习的图像识别系统实现

5.1应用需求

如今图像识别技术深入人们的日常生活,但图像识别系统的运作需要大量的高质量标注样本对模型进行训练。例如对动植物的识别系统,可利用大量现存图片进行训练。若我们想要对系统中不存在的类别进行识别,系统将会无法正常工作。而收集新类样本数据并重新训练新模型,也非常的耗时耗力。同时,某些样本(比如珍惜动植物)的图像资料稀少,系统利用这些数据训练的模型,难以获得良好的性能。

对抗元学习算法可以训练出更为“通用”的模型初始化参数,当出现新的图片识别任务时,可使用较少的标注样本便可以微调元模型,从而快速适应该任务,并具有较好的泛化性能。此外,对抗元学习算法也可以有效抵御对抗样本的攻击,使得图像识别系统拥有更高的安全性。

随着人力成本的持续增长以及智能化概念的引入,可使用智能终端设备进行图像识别。在传统云计算技术的方案中,智能终端设备通过实时网络接口向云端服务器发送待识别图片,云端服务器识别图片后,将识别到的图像类别标识信息通过网络接口返回给智能设备,智能设备再针对获取的信息进行相应的处理。上述方案对网络有较强的依赖,在一些对实时性要求较高或网络状态不好的情况下,推理的过程可能延迟,影响本地业务进行。并且,若所有的图像识别过程都交由云端服务器负责,也会对云端服务器造成较大的压力。

第六章 总结与展望

6.1本文总结

在大数据“爆炸式”发展的今天,深度学习高度依靠海量数据进行训练。但某些领域里,样本数据并不充足,这导致深度学习无法在只有少量样本量的场景下上发挥其应有的作用。少样本学习的研究旨在解决这种类型的问题,其中元学习的训练过程与“人工智能”概念高度符合,可以在学习到的元知识基础上仅使用少量带标注样本便可适应新任务。但也由于训练样本的数量少,导致元学习算法容易受到对抗样本的攻击。

本文主要研究元学习的对抗鲁棒问题,在模型无关元学习算法的基础上提出了改进方法:

1、在模型无关元学习算法的损失函数中同时引入对抗鲁棒正则化项和任务无偏熵正则化项以提高模型的对抗鲁棒以缓解模型在现有任务训练数据上的过拟合问题;

2、引入半监督学习方法,允许模型从额外的未标注样本数据中学习数据特征,以进一步提高算法性能。还允许未标注样本集中包含训练集中未见过类,能够减少这些未见过类数据的干扰,使得所提出的算法应用更符合现实场景;

3、引入焦点损失,并提出焦点损失中的调制参数应以动态方式增加,目的是在模型训练前期,可以基本平等地对待难和易两种分类任务;在训练后期,则更关注易受对抗样本影响的难任务,这更适合元训练的不同阶段对难和易两种任务的需求。

本文在MiniImagenet与CIFAR-FS公开数据集上进行实验,验证了本文提出方法的可行性和有效性。此外,本文设计并实现一种基于元学习的图像识别系统。该系统使在云端训练元模型,在边缘节点进行本地推理,以节省云端计算资源,降低延迟。

参考文献(略)