本文是一篇计算机论文,本论文对深度学习医学图像处理中的分类与分割模型以及基于对比学习方法的自监督学习进行了研究,对网络模型实现一定改进,同时将自监督学习方法应用到网络模型中进行性能优化。

第1章 绪论

1.1 研究背景及意义

医学图像是诊断和治疗中不可或缺的参考,实现自动化的医学图像处理是智能医疗技术的重要部分。自从机器学习的方法被提出以来,图像处理技术得到了快速的发展。基于神经网络的深度学习方法出现后,在图像分类、图像分割等任务上取得了超越传统方法的结果[1][2]。神经网络可以用于处理规则不明确、相对复杂的问题,使用数据以及对应的标记数据进行训练,可以实现对数据的自动处理。深度学习也带动了医学图像处理方法的进步,方法的效率和精度得到了很大的提升。但是基于深度学习方法的医学图像处理,目前尚存在以下几个问题:

1)标记数据数量难以增加。目前医学图像处理方法的主流是监督学习的方法,在监督学习的方式下,标记数据越多,模型的效果越好。但是医学图像的标记工作需要专业的人员才能进行,而且部分涉及到病人的隐私。因此,在现有条件下很难通过增加可用的训练数据来增强网络模型的性能。使用复杂的网络结构可以提高模型的性能,但是会使模型参数变多,增加计算量,出现在设备上难以部署的问题。

2)没有通用的预训练模型或方法。相比于随机初始化的网络模型,经过预训练后的网络模型可以取得更好的结果。对于自然光成像的图像处理,可以使用经过ImageNet预训练后的模型[3]。但是医学图像与自然图像之间存在很大的差别,ImageNet预训练的模型在医学图像处理上表现并不好。而医学图像没有大规模的标记数据,并且通过不同成像方式得到的医学图像也有很大不同。这些导致在医学图像处理中难以获得通用的预训练模型或方法。

1.2 国内外研究现状

近年来,自监督学习方法被提出后,出现了很多相关的研究。本节将会简要地介绍自监督学习方法以及相关应用的国内外研究现状。

1.2.1 国外研究现状

在自监督学习的早期方法中,自监督学习常用的是基于上下文的方法,这种方法主要是根据数据本身的上下文信息设计前置任务。Noroozi等人将训练图像分成9个图像块[6],并将图像块输入神经网络,预测图像块的位置号码。通过这种前置任务让网络学习到了图像数据的内部特征,提高了在小数据集上的效果。Gidaris等人通过将图像随机进行0°、90°、180°、270°的旋转[7],训练神经网络对输入图像的旋转角度进行预测,使网络学习到数据的语义特征。

基于对比学习的自监督方法提出后,使得自监督学习具有了超越监督学习方法的潜力。Hjelm 提出了DIM方法[8],引入了全局特征和局部特征的概念。根据特征是否来自于相同图片来构造正样本和负样本,形成了对比的方法。DIM通过最大化输入样本和特征的互信息实现对数据特征的学习。Chen等人提出了一种基于对比学习的自监督模型[9],通过数据增强的方法构造数据的正负样本,网络模型学习正负样本之间的特征关系,改进了原有的自监督学习方法,使用更少的标记数据,在ImageNet的分类任务中取得了超越监督学习的成绩。

随着对比学习方法的兴起,出现了许多基于对比学习方法的研究成果。He等人提出了一种动量对比的方法MoCo[10],使用队列构建了动态的字典,实现了模型性能与batch size的解耦,一定程度上降低了batch size对自监督学习结果的影响。Grill等人解决了对比学习需要负样本的问题[11],使用两个互不对称的网络,训练网络对另一网络的输出结果进行学习。在预训练阶段只需要数据的正样本,在取得了更好结果的情况下,也进一步降低了batch size对模型的影响

第2章 相关理论基础

2.1 神经网络

2.1.1 神经网络的基础

神经网络的方法被提出以来,在分类与回归问题上取得了比传统方法和机器学习更优秀的成绩。神经网络是一种包含了多个层级的复杂模型结构,参考生物神经网络的结构与功能,模型中的每个网络层代表一种运算。与传统的方法相比,神经网络具有自适应的学习能力,网络模型中的众多参数以及多个层级组合形成的复杂结构,使得神经网络可以拟合任意线性和非线性的函数。此外,神经网络无需进行底层算法设计,主要依靠带标记的数据进行学习,因此在多种任务之中具有通用性。在硬件设备快速发展以及海量数据得到存储的今天,神经网络也不断发展并实现了许多领域中任务的自动化处理和高精度的结果,得到广泛的应用。

对于图像处理,全连接的网络层存在运算缺陷,全连接层在输入时需要将数据形状转化为1维,导致数据形状的相关信息无法进入运算。图像的形状中包含有重要的空间信息,RGB图像的每个通道之间也有密切的关联性。因此全连接层的运算无法充分利用图像内部的信息。卷积神经网络中引入了使用卷积运算的层[17],卷积运算通过使用具有一定尺寸的卷积核,实现了对2维数据的运算操作。卷积核是一种具有学习能力的滤波器,借助自身的感受野,逐步对图像进行运算。使用多个卷积核可以实现对多通道的图像数据进行操作。

2.2 注意力机制

2.2.1 注意力机制在神经网络中的应用

注意力机制其实是参考了人类观察物体的方式。一般来说,人们在观察一幅图片时,除了从整体上把握图片外,还会更多地关注图片的一些局部信息,这类信息往往是图片的核心内容[30],如照片中人物的面部。注意力机制其实包含两个部分:(1)注意力机制需要决定输入中的哪个部分需要得到更多的关注;(2)从关键的部分进行特征提取,进而得到重要的信息。因此,注意力机制会在输入中将更多资源分配给目标区域,提高信息处理的效率与准确性。

在深层神经网络的结构设计中,注意力分配的资源其实是网络运算的权重[32]。视觉领域的注意力机制的核心思想是在原始数据的基础上找出它们之间的相关性,然后突出一些重要特征。

使用注意力机制可以优化分割网络的输出结果,提升分割精度[33]。并且基于注意力机制的方法是一种轻量化的方法,无需设计更复杂的网络结构即可实现[31]。因此,期望使用基于注意力结构的方式对U-Net网络进行改进,增强网络模型的分割精度。

第3章 基于自监督对比学习的预训练方法 .................. 16

3.1 对比学习的模式的选择 .............................. 16

3.2 自监督学习方法的框架 .............................. 17

3.3 密集特征间的对比损失 .............................. 19

第4章 对比学习预训练在医学图像分割中的应用 ............ 27

4.1 分割网络的整体结构 ......................... 27

4.2 分割网络的通道注意力模块 .......................... 29

4.3 分割网络的空间注意力模块 .......................... 30

第5章 总结与展望 ...................................... 39

5.1 本文工作总结 ...................................... 39

5.2 下一步工作展望 .................................... 40

第4章 对比学习预训练在医学图像分割中的应用

4.1 分割网络的整体结构

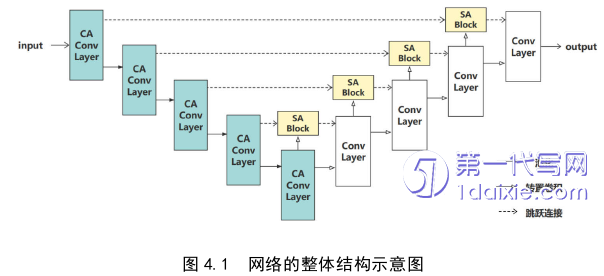

如图4.1所示,本章提出了使用基于注意力机构的分割网络模型。网络整体是类似U-Net的模型结构,采用编码器—解码器的形式。编码器的部分使用空间卷积层SA Conv Layer,对特征映射进行空间维度的精细化推导,提高了模型的特征提取能力。解码器的部分,采用多个卷积层Conv Layer作为解码器,同时使用注意力模块CA Block将上下文的信息进行基于注意力的细化,并通过上采样将其恢复到原始大小,最后得到分割结果。

第5章 总结与展望

5.1 本文工作总结

医学水平的发展与我们的生活息息相关,而医学图像处理作为医学分析中重要的方法,也越来越发挥了重要的作用,许多检查方式和治疗方案都需要图像处理技术作为支撑。自动化的医学图像处理技术也成为了医学技术发展的重要组成部分。基于神经网络的深度学习方法出现以后,自动化的医学图像处理有了很大的进步。神经网络的成功极大地依赖于具有标记的训练数据。但由于需要大量的劳动力和专业知识,以及受医学这个具体的应用场景的限制,很难通过增加可用标记数据的方法提高网络模型的性能。基于对比学习的自监督方法通过在无标记数据集中进行表征学习,提高了下游任务的准确率,因此在解决这一问题上具有很大的潜力。本论文对深度学习医学图像处理中的分类与分割模型以及基于对比学习方法的自监督学习进行了研究,对网络模型实现一定改进,同时将自监督学习方法应用到网络模型中进行性能优化,具体研究内容如下:

1)提出了一种基于对比学习的自监督预训练方法,用于提高医学图像模型的性能。使用基于卷积神经网络的特征提取方法,并将其与对比学习的训练范式进行结合,形成一种自监督学习的方法,学习图像数据的内部表征。在无标记的医学图像中学习潜在的特征表示,使用对比损失函数,让模型在高维向量空间中学习图像的内部特征。方法所使用的模型由两个不同的网络所组成,输入为同一图像的不同增强视图,让网络预测另一网络输出的结果。同时,使用主干网络的权重参数对另一网络进行参数的缓慢更新。提出了密集特征的对比损失计算方法,使模型可以学习到更多的数据内部信息,提高了自监督学习的效果。在下游微调任务中,使用现有的标记数据对网络模型进行再次训练。实验结果表明,该方法在不增加已有数据量的情况下,合理使用了未标记的数据,提升了模型的性能,验证了自监督学习的有效性。

2)将基于对比学习的自监督方法应用于医学图像分割之中。提出了基于注意力结构的医学图像分割网络,网络通过注意力模块分别在空间和通道两个维度进行注意力映射的推导,然后将注意映射与输入特征映射相乘,并实现自适应的特征细化,突出对分割目标有用的显著特征。并且使用提出的自监督学习方法与网络模型结合使用。实验结果表明,注意力结构可以提高网络提取特征的能力,提高图像分割的精度,同时结合了基于对比学习的自监督学习方法,使模型的性能得到有效提升。

参考文献(略)