本文是一篇计算机论文,本文所提出的模型框架均较为简单,和以往参数量较大的网络相比,拥有较低的时间复杂度,在两个标准数据集NELL-One以及Wiki-One上进行的扩展性实验,均验证了本文模型比所选基线达到更好的预期效果。

第1章 绪论

1.1 研究背景及意义

互联网作为信息交换的媒介,其中信息量巨大且呈爆炸式增长的态势,各种类型的信息具有异质多元的特点,且不具备有效的组织结构,因此如何有效获取和处理信息成为亟待解决的问题。由此产生了语义网络到知识图谱等一系列概念。

语义网络是一类以有向图的形式描述实体、概念和相应语义关系的结构,由J. R. Quillian于1968年提出,它是语义信息的直接化表达,符合人的思维方式,使得语义和语义关系较容易被理解。语义网络可以实现实体和概念间语义层次和结构层次的建模,自然直接地表达其中的知识和知识间的关联,它根据信息之间的逻辑关系和结构特性进行相应的推断,从而增强对知识的理解和应用。它更适用于静态和规模不确定的知识,不适用于描述知识的变化情况。随着互联网的不断发展和Web技术的不断演变,语义网作为Web3.0的特征之一[1],它的核心是为互联网上各种类型以及格式的文件添加“元数据”,使得网页信息成为机器可读,实现互联网数据更为丰富的表达,这些机器能够理解的数据链接在一起成为一个庞大的信息交互网络。语义网可以根据语义进行逻辑判断,实现人脑与机器之间的交流,可以理解各种词语、概念以及这些本体之间的逻辑关系,拥有像人脑一样强大的思维能力。从而在面对互联网用户的各种需求时,能检索到匹配度较高的信息,实现各类数据的高效整合,在面临繁重任务时减轻用户的负担。本体的提出要早于知识图谱,它用于表达事物的类型、事物的属性以及各个类型之间的关系。和知识图谱相比,本体是对某一类的属性建模,并未实现对个体事物特点进行的具体表达。其主要由类、属性和关系组成,其中,类依据数据的不同类型进行区分,属性表示某个单一类的特征,关系是抽象出的不同类之间的属性。本体可以看作是知识图谱的构建基础。

1.2 研究现状

研究人员们针对小样本知识图谱补全问题进行了如下探索。单样本关系学习模型(GMatching)[3]最先被提出,其中包含两个模块,一个模块通过聚合邻居信息增强知识图谱局部邻域交互信息的表示,这一部分只考虑了实体的单跳邻居,另一个是应用长短期记忆网络(Long Short-Term Memory networks,LSTM)进行多步匹配的模块,它由上一个模块得到的实体对的特征表示,执行多步匹配,并输出一个标量作为相似度得分。但它假设所有邻居的贡献相等,因而通过邻域信息获取的实体和关系表示是静态的。然而同一实体对于不同任务关系的角色不同,同时某一任务关系传递消息到不同实体时,实体特征表示关注的特性不同,同一任务关系的参考实体对,它们对于查询三元组的贡献不同,因此上述静态实体表示不能充分表达知识图谱中的信息。如果将面向单样本知识图谱补全的模型针对小样本知识图谱补全任务进行改进,通过添加池化层产生给定的其他参考实体对的表示,可能不适用于小样本场景。在此基础上,小样本关系学习模型(Few-Shot Relation Learning model,FSRL)[4]由异质邻居编码器、参考实体对聚合部分以及查询集的匹配部分三个模块组成。其中的异质邻居编码器引入了注意力机制聚合相邻关系和实体的信息,首先将预训练的关系嵌入和实体嵌入拼接,通过前馈神经网络计算邻域内实体相应的注意力,通过对参考集信息的聚合实现关系嵌入的特征表示。然后使用循环自编码器融合参考实体对的嵌入,为了增强参考集嵌入的准确性,作者聚合了所有编码的隐藏状态,并通过残差连接与注意力权重机制对其进行扩展。第三部分在前两个模块的基础上利用循环神经网络(Recurrent Neural Networks,RNN)衡量参考实体对和查询实体对的相似性,然而该模型的泛化能力较差。

第2章 问题定义与相关技术研究

2.1 基于嵌入的知识图谱补全模型

目前已有大量方法完成知识图谱的构建任务以及推断不完全三元组的缺失部分,基于嵌入的方法的研究重点为如何获取实体和关系在低维向量空间中的有效表示。这类方法大体上可以分为三类:张量分解模型、几何模型、以及基于深度神经网络的模型。

2..1张量分解模型

这类模型将不完全三元组和缺失部分预测的组合表示为一个三阶张量,之后将其分解为头实体、关系和尾实体嵌入的组合。其中包括一些轻量级的模型,例如双线性模型(RESCAL)[13]首先将每个关系抽象为一个二阶矩阵,之后根据实体与实体之间是否存在对应的关系将知识图谱描述为一个三阶张量,将得到的三维矩阵分解为一个非对称矩阵和实体的隐含表示的组合,由于该矩阵的非对称性,该模型可以兼顾三元组中对称关系以及非对称关系的描述以及之后的预测,并由此计算得分函数。之后的两个模型在RESCAL的基础上进行了改进和扩展。双线性嵌入模型(DistMult)[14]将上述关系矩阵简化为对角矩阵,从而将参数量降低到与基于翻译距离的嵌入模型(TransE)相同的规模,但也因此不适用于非对称关系的情况。该模型主要关注于规则的抽取,由知识图谱抽象出可推理新事实或新实体的规则,它用于补充不完全三元组,该规则不受知识图谱的规模的限制,并且可以作为所推断结果的解释。在占用空间方面,对规则的存储要优于对实体或事实的存储。基于复数空间嵌入的链路预测模型(ComplEx)[15]将关系矩阵对应的三阶张量在复数空间中进行分解,得到实向量成分和虚向量成分,根据虚实两类成分的复数点积计算得分函数。对于由头尾实体对应嵌入计算出的点积,它的实部在复空间中是对称的,而虚部是不对称的, 所以既适用于对称关系的表征,也能解决非对称关系的问题。

2.2其他知识图谱补全模型

在知识图谱构建过程中,存在一些方法利用关系路径推理构建复杂关系文本路径,相应的利用PRA算法进行知识库补全的模型也不断涌现,比如模型CPRA[30],它是以通过实体间的现有关系推理出新的潜在关系的PRA算法、表示学习模型和概率模型为基础进行构建的。PRA算法为知识库中的关系独立建模,即为每个关系学习一个独立的分类器,而CPRA对某一类相似的关系集体建模,用多任务学习代替单任务学习,根据关系路径之间的相似度将关系分成不同的组,对一个组中的关系,共同训练一个分类器,其中包含两部分参数,共享参数以及私有参数,共享参数用以描述同组关系之间的共性,私有参数用来表达组内各个关系的特性。这类将PRA应用到KGE的方法能够取得较好的效果,但是还存在一些问题,比如只考虑了路径信息,而忽略了节点信息,同时随着路径类别的增加,推理的效率也受到影响。基于强化学习的路径选择方法将对三元组的预测定义为马尔可夫决策过程,从而将其转化为可以被强化学习解决的序列决策问题。例如GRL[31]将知识图谱补全问题定义为马尔可夫过程,并探索在状态转换过程和奖励两个方面都可以引入的规则,从而更好地指导生成对抗网络( Generative Adversarial Networks,GAN)在优化下的游走路径。基于规则推理的方法提取实体和关系间的逻辑规则从而得到他们的特征表示,逻辑规则是一种辅助信息,它可以结合先验知识,达到实现多跳推理的目的,并为泛化提供基础。单独的逻辑规则只能覆盖知识图谱中有限数量的关系和实体,同时搜索空间较大,因此将基于规则的学习方法结合到知识表示中在遍历大规模知识图谱时,可能会出现连通性不足的问题。AttnPath[32]将基于规则、基于嵌入和基于强化学习的方法相结合,在一些仅基于嵌入方法的基础上实现了效果的提升,这也为之后的研究提供了思路。此外还有三元组分类的方法,它将知识图谱补全任务视为三元组分类问题,使用特定阈值的得分函数来衡量三元组的准确度,从而区分三元组的正确预测以及错误预测。

第3章 基于邻域信息融合的小样本知识图谱补全模型 ..................... 16

3.1 图注意力网络 ..................... 16

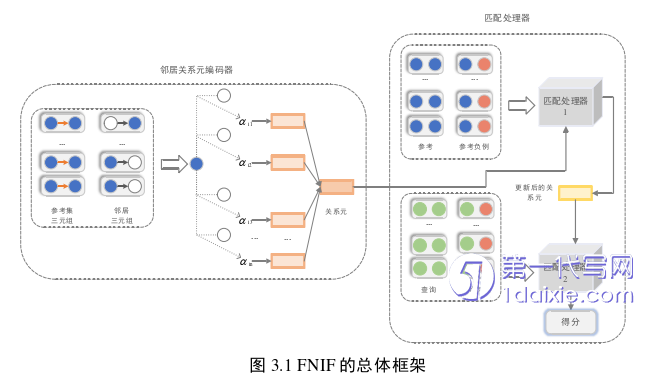

3.2 FNIF模型整体架构......................... 17

3.3 邻居关系元编码器 ........................ 18

第4章 面向小样本知识图谱补全的查询实体优化 ............................. 33

4.1 Transformer编码器 .............................. 33

4.2 FTCN模型整体架构 ................................... 35

4.3 关系元学习器 .......................... 35

第5章 总结与展望 ............................ 41

第4章 面向小样本知识图谱补全的查询实体优化

4.1 Transformer编码器

Transformer[50]是一个完全依赖注意力机制描述输入和输出的全局依赖关系模型,具有高质量、并行化和训练时间短的特点,它遵循编码解码器结构,由自注意力层和全连接层堆叠而成。本文采用的是Transformer编码器,它由6个相同的层组成,其中一层的结构如图4.1的左图所示,每一层包含两个子层,其中第一层是多头自注意力层,第二层是全连接层,在每个子层中都包含残差连接和归一化操作,每层的结果作为下一层的输入,编码器的输入是由词嵌入和位置嵌入相加得到的。

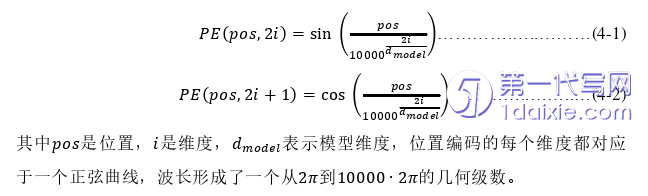

由于模型中不包含递归和卷积操作,采用位置编码解决相对位置和绝对位置信息获取的问题,而为了使模型较容易地学习相对位置,选择正余弦函数,因为对于任何固定的偏移量𝑘,𝑃𝐸𝑝𝑜𝑠+𝑘可以表示为𝑃𝐸𝑝𝑜𝑠的线性函数,使用不同频率的正余弦函数计算位置嵌入:

第5章 总结与展望

由于网络中的信息具有异质多元的特点,知识图谱以关系图的形式组织相关信息,但知识图谱存在实体或关系缺失的情况,并且其中的部分关系满足长尾分布,为此本文面向小样本知识图谱补全任务,首先研究了用于解决常规知识图谱补全问题的各类方法,比如基于嵌入的方法、元学习方法、基于规则推理的方法、基于强化学习的方法以及三元组分类的方法,对比分析了应用上述方法的一些具有代表性的模型,总结了各类方法的特点以及优缺点,考察了各类模型是否适用于小样本知识图谱补全问题。在此基础上,本文选取样本规模为5,以对尾实体的预测为例对上述问题进行了相关研究,首先提出了FNIF,并在此基础上,为优化查询实体嵌入提出了另一个模型FTCN,本文的主要研究内容如下:

(1)引入元学习的概念,设计了两个用于解决小样本知识图谱补全问题的模型,将长尾关系嵌入作为可迁移的元信息,将其从参考集迁移至查询集中,并通过梯度更新的方式实现了关系元的优化,加速了训练过程。

(2)部分现有小样本知识图谱补全模型计算的是实体或关系的静态特征表示,未能区分邻域中不同实体信息对中心实体或关系嵌入的作用。而本文的模型FNIF应用GAT更加高效地聚合了实体邻域信息,并用实体相关性描述关系相关性,将实体间的交互以及关系和实体间的不同角色更准确的表达出来,从而获取任务关系的特征表示。

(3)本文提出了另一个小样本知识图谱补全模型FTCN,应用CNN和Transformer分别建模任务关系和查询实体,从而实现参考集信息的高效利用,基于CNN的关系元学习器将实体信息编码至关系信息中,基于Transformer编码器更新实体嵌入的模块充分利用了其中的自注意力机制,实现了和元学习方法的高度融合。

(4)本文所提出的模型框架均较为简单,和以往参数量较大的网络相比,拥有较低的时间复杂度,在两个标准数据集NELL-One以及Wiki-One上进行的扩展性实验,均验证了本文模型比所选基线达到更好的预期效果。

参考文献(略)