本文是一篇计算机论文,本文致力于降低深度点云处理算法对于标签数据的依赖,从点云的自监督表征学习和迁移学习两个角度出发对该问题进行了全面的研究。

1 绪论

1.1 研究背景及意义

随着高精度三维传感器技术的不断发展及其越来越广泛地应用,对点云数据进行处理并提取其中的所需信息已经成为三维计算机视觉中的一个重要课题。点云是描述场景或物体表面信息的一系列离散三维坐标点的集合,有着丰富的三维空间信息和几何结构特征,对于真实世界中三维场景的重建和理解有着重要的价值,也因此被广泛应用于自动驾驶、智能制造、机器人视觉和增强现实等应用场景中[1][2]。在近几年中,基于深度学习的点云处理算法[3][4][5][6][7][8]取得了丰硕的成果,这在进一步推动了相关技术进步的同时,也对点云模型的性能和表征能力有了更高的要求。然而,深度学习模型性能的提升通常需要以数据驱动,而点云数据的获取成本和标注成本要显著高于图像和自然语言处理等领域,其数据量规模更是相差多个数量级,因此传统的基于监督学习的点云处理算法普遍面临着成本高或者模型表征能力不足的问题。

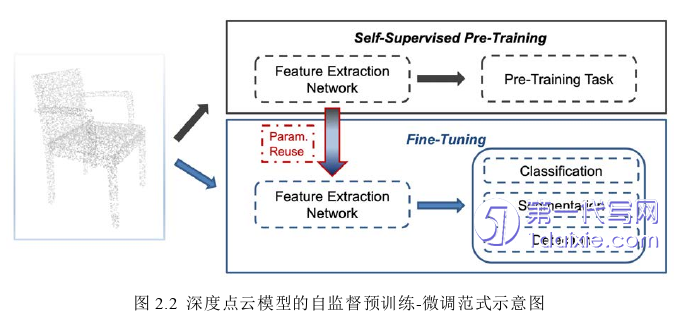

受图像处理和自然语言处理等领域预训练-微调范式(Pretraining-Finetuning Paradigm)一系列成果[9][10][11]的启发,为解决点云处理领域中存在的数据规模较小且人工标注成本较高等问题,研究人员也展开了此类方法在点云数据中的相关研究。预训练-微调的范式主要包含两个步骤:首先在相对大规模的数据中进行预训练[12][13][14][15][16][17],随后将预训练模型学习到的“知识”使用迁移学习[18][19]应用至下游任务中,并通过模型训练以进行部分或全部参数的更新。受限于点云缺乏具有标签信息的大规模数据集等问题,自监督表征学习的重要性在点云预训练这一阶段中得到了进一步的凸显。此外,点云处理中的迁移学习相关研究和应用仍处于相对滞后的状态,而使用何种迁移学习方法以有效利用预训练阶段学到的知识同样至关重要。尽管基于自监督表征学习的预训练-微调范式在点云处理中取得了一些成果,然而,目前此类方法仍然存在一些问题:一是目前的自监督表征学习方法通常难以同时有效应用于物体级别和场景级别的点云;二是受限于目前的点云数据集规模,导致点云预训练模型难以具备较强的表征能力和泛化性能,在迁移至高层视觉任务中时可利用的预训练阶段获得的先验知识较为有限。

1.2 国内外研究现状

自监督学习(Self-Supervised Learning)[12][9][20]是指使用数据自身特性生成的标签信息以训练神经网络的方法,此类方法无需人工标注的信息,属于无监督学习(Unsupervised Learning)中的一个重要类别。近年来,自监督学习得到了研究人员广泛的关注,由于其可在无人工标注信息的情况下自主进行表征学习,因此可显著降低训练神经网络所需的人力成本和标注时间成本。而由于点云数据的标注更为困难、人力成本相比其他领域明显更高,该特性使自监督表征学习在点云处理领域的重要性得到了进一步凸显。使用有效的自监督学习方法对神经网络进行训练的过程中,可使神经网络自主学习点云数据的多层次抽象特征表示,训练得到的模型可对特定任务作出预测,或基于迁移学习应用于下游的底层或高层视觉任务中。

迁移学习[21]则是指将神经网络学习得到的“知识”在不同任务、模态或数据集中进行迁移,由此便无需随机初始化网络参数以及无需在大量有标签数据中进行训练,可有效减少下游任务中所需的数据量和训练成本。由于研究者们在迁移学习的相关研究中进行了深入探索,基于深度神经网络模型的迁移学习在自然语言处理和图像处理等领域的各传统任务中均取得了明显的提升,更是催生出了众多的重要新型应用[12]。迁移学习在点云处理领域也有着一定的研究,在降低对点云标签信息的依赖上取得了显著的成果。

本文基于自监督学习和迁移学习,对当前点云处理算法中面临的数据缺乏和人工标注成本较高等问题展开全面的研究。

2 相关理论与技术简介

2.1 点云数据的特性

点云(Point Cloud)是用于描述三维物体表面形状及其结构信息的一种数据格式,被广泛应用于各种重要的三维视觉任务中,如三维重建、三维姿态估计、三维目标检测和机器人视觉等。点云由一组三维坐标点构成,其中每个点均位于所采样物体或场景的表面。点云数据的获取通常需要借助3D扫描设备,例如雷达、RGB-D相机等,以获取真实场景或物体的三维特性。然而,由于数据获取过程中存在着环境干扰、扫描精度不足、检测范围有限等因素的限制,点云数据可能存在噪声、缺失等诸多问题。此外,点云数据的处理和分析受到物体表面形状不一致的限制,形状复杂或不规则的物体会使分析和处理变得更加困难。因此,点云数据的无序性和不规则性是点云处理领域中需要解决的重要问题。

2.1.1 点云的无序性

点云的无序性是指点在三维空间中的位置与其数据形式的排序方式之间不存在固定关系的性质。即对于一个给定的点云数据而言,无论将其中的点如何排序,都不会改变该点云所表示的三维空间语义信息。具体而言,给定一个包含N个三维坐标点的点云 ={ !, ",..., #},则点云P在该数组中有 = !=∏ #$%!种排列方式,且此M种排列方式下的点云P均表示相同的信息,而在实际应用中穷尽M种排列方式以表示同一个点云的信息是不现实的。正是由于存在着这种特性,点云数据的处理相较于有序的图像和文本数据而言有着更大的难度,例如有着索引和搜索效率低下、难以使用有效的形式表示同一点云等问题。

2.2 PointNet

由于点云具有无序、不规则性等性质,早期的深度学习方法[38][50]都需要将其转换为三维体素网格(3D Voxel Grids)或投影成二维图像等形式,然而在该过程中会丢失一定的点云三维结构特性。PointNet[3]是使用神经网络处理原始点云数据的先驱,且该方法中使用的相关技术和理论在其之后的研究中被广泛借鉴和使用。PointNet设计了一个具有置换不变性(Permutation Invariance)的神经网络,该网络具有结构简单、能广泛应用于分类和分割等任务的特性,这些特性主要基于两个重要的组件:具有置换不变性的对称函数(Symmetry Function)和结合局部与全局信息的结构。

(1)具有置换不变性的对称函数

该对称函数主要由两个部分组成,逐点提取特征的多层感知机(Multi-Layer Perceptron, MLP)网络和最大池化操作。具体而言,首先使用MLP网络对有着N个点的输入点云逐点提取特征,由于该过程中得到的点特征与其在点集中的序号无关,因此该特征提取过程具有置换不变性。经过特征提取后可得到特征图,其中C表示每个点特征的维度。随后该对称函数使用最大池化(Max Pooling)操作在FP的每个通道上取最大值得到,由于对FP中的点特征进行任意排列后该操作均能得到一致的特征GP,因此该操作对于无序点云仍具有不变性。由此,对于在三维空间中表示相同三维特性的点云P而言,尽管其有着N!种排列方式,该对称函数均可得到一致的全局特征GP。该组件的结构较简单,然而在实验中表明仅使用全局特征GP便可实现较高的点云分类精度,在当时取得最佳性能,并启发了后续大量的深度点云处理算法。

3 基于高斯混合模型的自监督点云表征学习方法 ............................. 13

3.1 引言 ........................... 13

3.2 基于高斯混合模型的自监督表征学习方法网络结构 ................................... 14

4 基于跨模态模型的点云迁移学习方法 ........................ 26

4.1 引言 .................................. 26

4.2 跨模态迁移学习方法的网络结构 ....................... 27

5 总结与展望 ..................................... 38

5.1 工作总结 .................................... 38

5.2 未来展望 ................................... 38

4 基于跨模态模型的点云迁移学习方法

4.1 引言

近年来,预训练-微调的范式(Pretraining-Finetuning Paradigm)在自然语言处理[12][18]和2D图像处理[9][10][19]等领域取得了大量成果。这种范式的核心思想是,首先在大规模数据集上对主干网络进行充分的预训练,以从数据中获得大量的先验知识,随后通过迁移学习将这些先验知识应用于下游任务中,以提升模型在下游任务中的性能。

对于深度神经网络模型的迁移学习而言,预训练模型的先验知识对于迁移之后在下游任务中的表现有着很大的影响,而获得大量先验知识的一个前提是预训练模型需要以高效的策略在较大规模的数据中进行预训练。近年来受到广泛关注的CLIP[13]模型使用超过4亿对图像和文本数据对模型进行对比学习(Contrastive Learning)预训练,使其学习到了大量的高质量视觉先验知识,并具有强大的表征能力和泛化能力。2D图像和文本信息之间的内在对齐关系也使其可以灵活地应用于少样本学习甚至是零样本学习。

而在3D计算机视觉领域,当前大多数的点云预训练方法都仅在数据规模相对较小的点云数据集中进行预训练,例如ShapeNet[69]或ScanNet[48]数据集。ShapeNet包含约50000个合成3D物体数据,ScanNet包含约1700个室内房间中的真实扫描数据。与2D图像领域中的先进预训练方法CLIP所使用训练数据量相比,3D点云的训练样本数量不及其千分之一,在数据规模上存在着数个数量级上的差距,因此3D点云预训练方法从小规模的训练样本中学习到的先验知识较为有限,导致其泛化能力和表征能力与2D图像模型存在着一定的差距。

5 总结与展望

5.1 工作总结

在三维点云处理算法的实际应用中,由于点云数据较高的采集成本和数据标注成本,使得其应用场景和性能受到了一定的限制。为降低对点云数据和标签的依赖,本文主要对点云自监督表征学习和跨模态迁移学习展开了研究,并均取得了一定的成果。具体的工作总结如下:

(1)对点云配准任务进行重新建模与分析,结合高斯混合模型理论,通过待配准的两个点云样本信息重建其共同表示的高斯混合模型分布,并根据该过程中的约束信息构建自监督损失函数,使网络得以有效地进行自监督表征学习并重建高斯混合模型所表示的分布。由于该策略基于点云配准任务进行构建,除了可用于模型的预训练外,还可在无需人工标注信息的情况下直接应用于点云配准任务中,显著降低了对标签数据的依赖。与最先进的基于监督学习的点云配准算法相比,本方法在精度和效率上均有一定的优势,且在合成数据及真实数据中均通过大量实验验证了其在点云配准任务和自监督表征学习中的有效性。

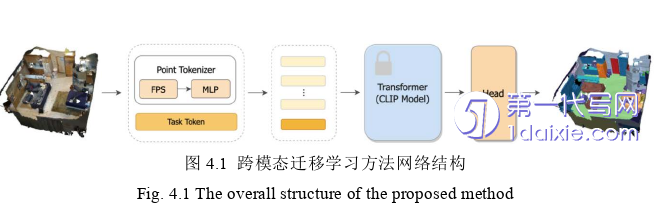

(2)目前点云领域中缺乏具有强表征能力的预训练模型,与之相反的是,2D图像领域中已有大量相关的高质量研究。从这个现象出发,本文进行了将2D CLIP Transformer预训练模型高效应用至点云任务的迁移学习研究。具体而言,本文首先使用点云符号化模块将点云映射至CLIP 视觉Transformer的特征空间中,使点云和图像在特征空间中具有相同表示形式;随后,为使Transformer编码器针对不同任务具有更佳的迁移学习能力,本文还设计了一个可学习的任务编码模块,为各下游任务以及存在的模态差异问题提供偏置信息;最后,Transformer编码器在高维特征空间中逐步更新点云特征,并与其预训练过程中得到的知识进行关联,用于下游任务的预测。大量实验证明,本文的跨模态迁移学习方法能将2D图像中所学习到的知识与3D点云语义信息在特征空间中进行有效的关联,并帮助点云学习到良好表征,因此在多项点云高层视觉任务中均取得了同类方法中最佳的性能。

参考文献(略)